L’interface d’Oncrawl se veut très user friendly et générique avec des graphiques et des visualisations pertinentes. Mais lorsque le besoin est plus poussé dans l’analyse des données, il est essentiel pour nos utilisateurs de pouvoir requêter Oncrawl d’une façon plus personnelle.

Les filtres Oncrawl, qu’ils soient Quick ou Customs – comprenez des filtres de données pré-écrits ou personnalisés – sont la solution aux analyses personnalisées et complexes d’un ensemble important de données issues de vos projets.

Si vous maitrisez déjà le Data Explorer et souhaitez consulter nos 17 Filtres Custom cliquez ici.

Oncrawl est un puissant système qui compile et créé un ensemble de métriques orientées SEO. Mais notre data-plateforme est avant tout basée sur une API qui permet de requêter l’ensemble des données compilées de votre projet au travers du Data Explorer.

Comment le Data Explorer fonctionne t-il ?

Le Data Explorer est l’interface à privilégier pour des analyses poussées car il permet de parcourir l’ensemble de vos données en manipulant notre langage de requête OQL (Oncrawl Query Language LINK?).

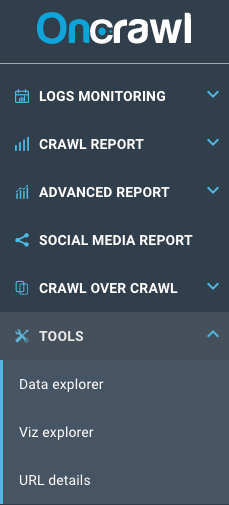

Le “Data Explorer” est disponible dans la partie “Tools” en bas du menu de l’application.

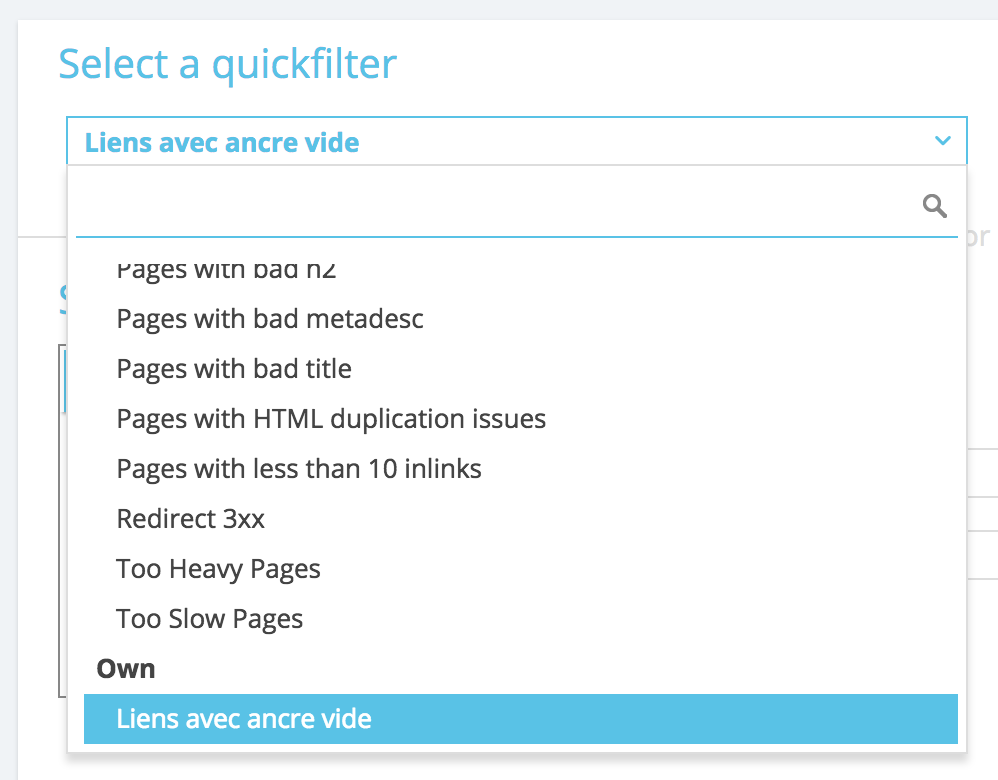

Vous trouverez dans le Data Explorer des “Quick Filters” qui sont des filtres pré-remplis par notre équipe d’experts SEO.

Ils sont la première étape possible pour la création de vos propres filtres ; les Customs Filters (own filter) que nous allons aborder dans cet article.

À quoi servent les Quick Filters ?

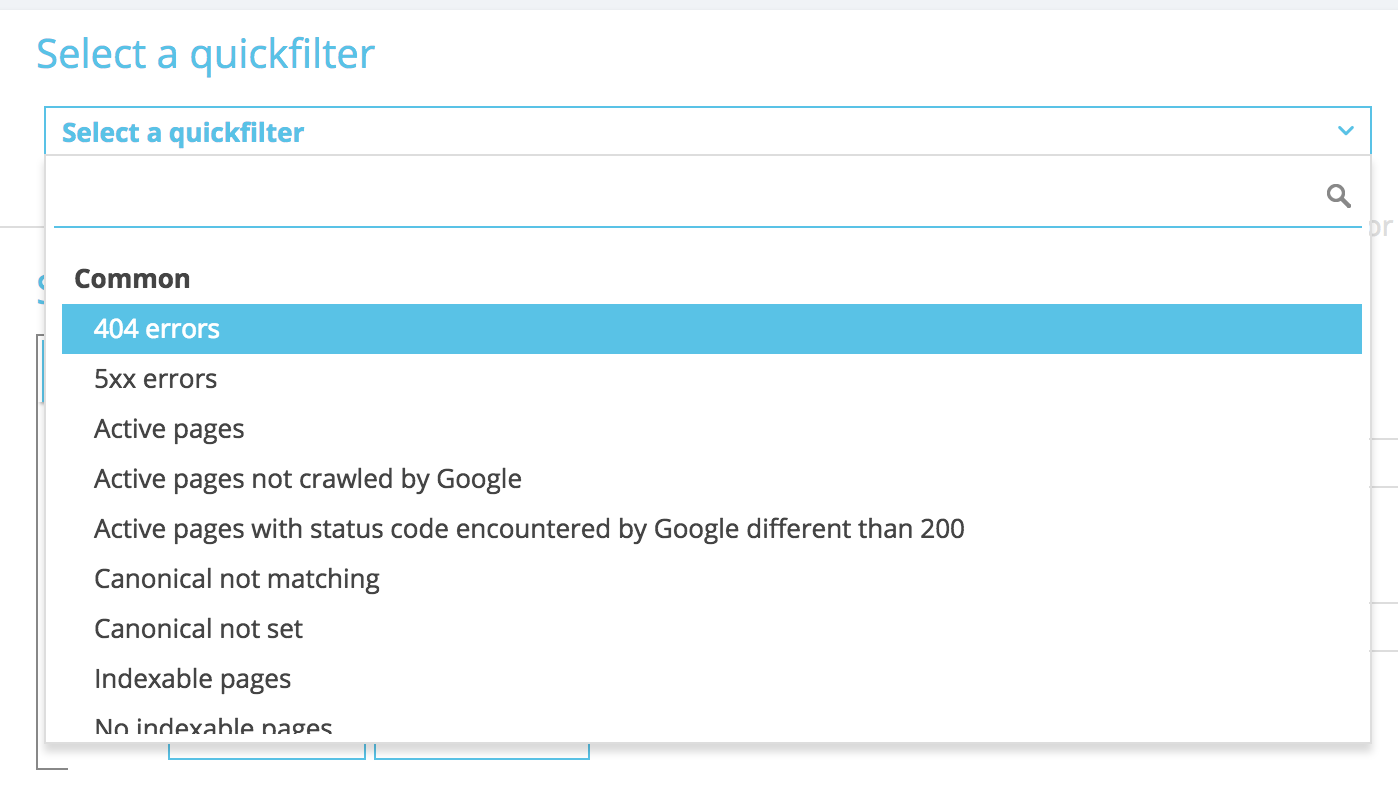

Les “Quick Filters” ont été créé pour vous faciliter l’accès à certaines mesures SEO importantes.

Dans le champ “Quick Filter” vous avez déjà accès à des filtres très importants qui vous feront pointer rapidement des Quick-Wins SEO à travailler, comme par exemple les liens pointant vers des 404, 500 ou 301/302, les pages trop lentes ou trop pauvres en contenu etc.

Voici la liste complète :

- 404 errors

- 5xx errors

- Active pages

- Active pages not crawled by Google

- Active pages with status code encountered by Google different than 200

- Canonical not matching

- Canonical not set

- Indexable pages

- No indexable pages

- Orphan active pages

- Orphan pages

- Pages crawled by Google

- Pages crawled by Google and Oncrawl

- Pages in the structure not crawled by Google

- Pages pointing to 3xx errors

- Pages pointing to 4xx errors

- Pages pointing to 5xx errors

- Pages with bad h1

- Pages with bad h2

- Pages with bad metadescription

- Pages with bad title

- Pages with HTML duplication issues

- Pages with less than 10 inlinks

- Redirect 3xx

- Too Heavy Pages

- Too Slow Pages

Mais il arrive que ces “Quick Filters”, pensés de manière générique, ne soient pas assez détaillés pour être pertinents sur votre projet ou que vous vouliez étudier un ensemble précis d’urls répondant à des conditions précises – un groupe de page de votre segmentation, une typologie d’url en particulier ou pourquoi pas un ensemble de pages ne recevant pas de visites du bot Google ou de visites SEO.

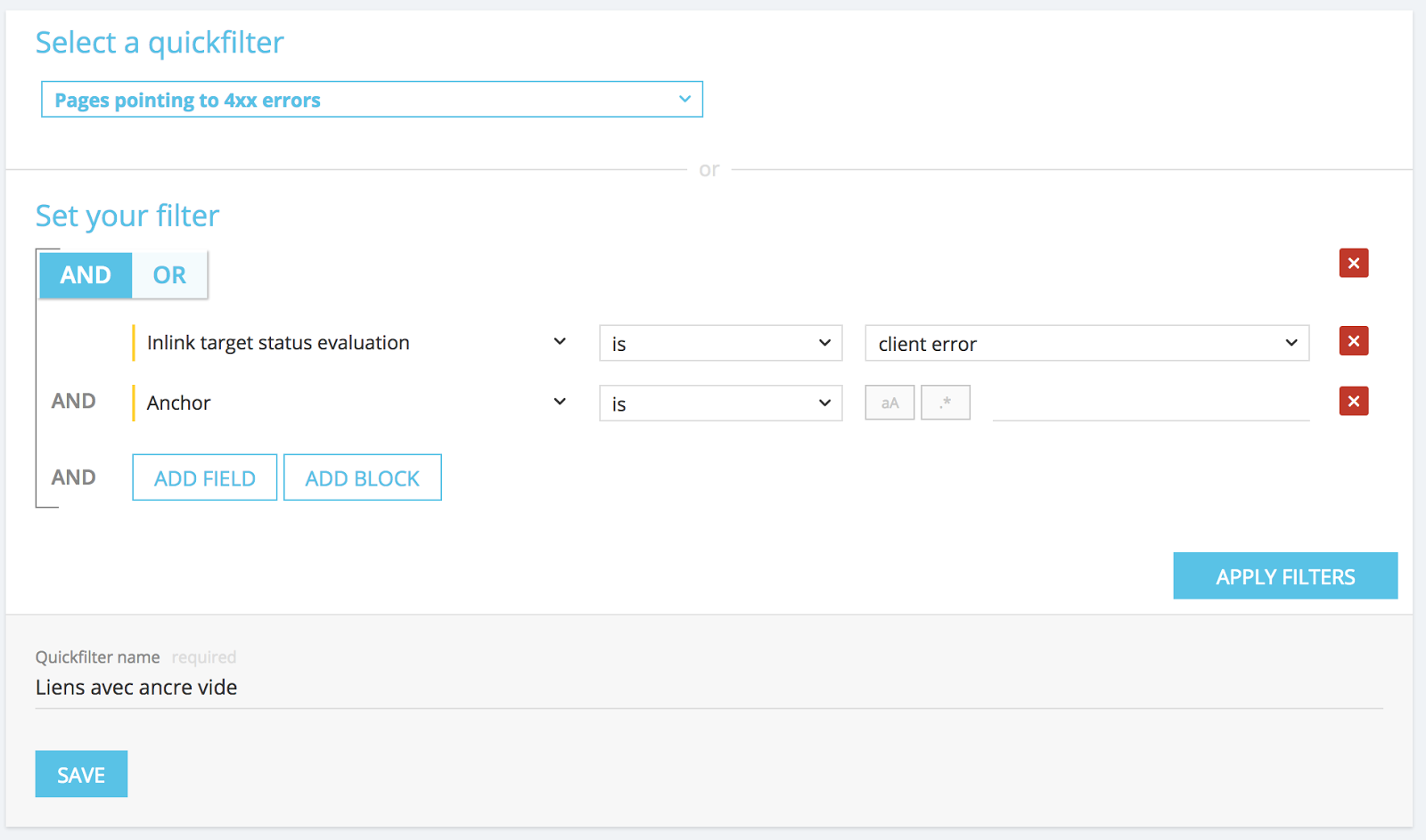

Lorsque vous choisissez l’un des Quick Filter, l’interface évolue en dessous pour afficher la configuration du filtre. La table des données en dessous de la configuration est, elle aussi, mise à jour. C’est là que les données peuvent commencer à vous parler.

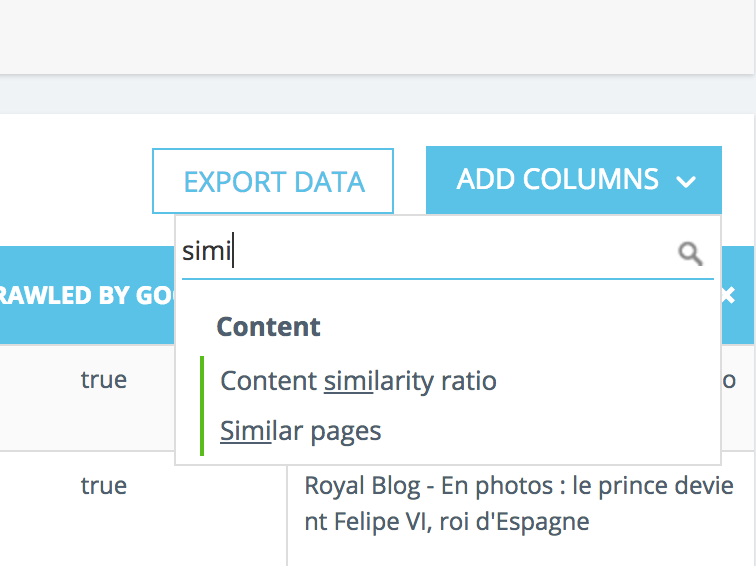

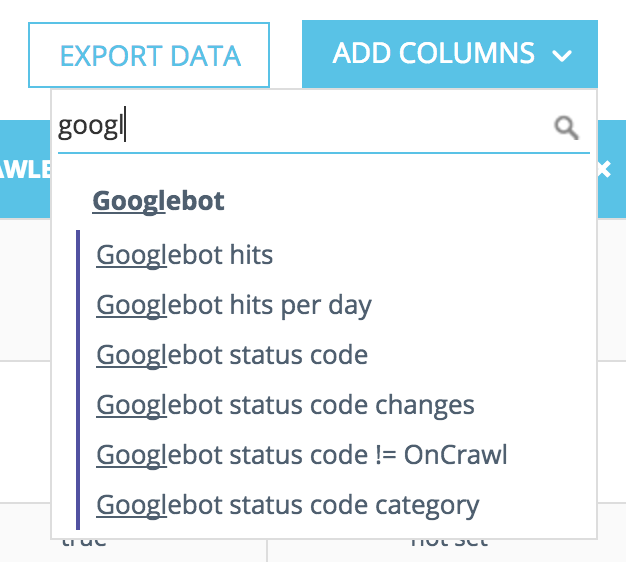

PRO TIP : Nous vous conseillons d’enrichir la data table en ajoutant des colonnes en fonction des analyses que vous êtes en train de mener.

Encore une fois toutes les données sont disponibles pour toutes les urls, c’est à vous de faire votre choix de métriques. Évidemment cette table peut être exportée en CSV une fois bien configurée.

Les Custom Filters sont des Quick Filters améliorés

Nos “Quick Filters” sont puissants mais si vous souhaitez aller plus loin dans la requête et enregistrer vos propres filtres, c’est là que les Customs Filters ou Own Filters entrent en jeu.

Vous avez surement remarqué le champ Name, il permet de donner un nom à votre filtre personnalisé pour ensuite le retrouver en bas de la liste des “Quick Filters”. Mais d’abord voyons comment fonctionnent les filtres.

Comment les filtres fonctionnent-ils ?

Les données disponibles sont nombreuses et les possibilités de filtre y ajoutent une flexibilité importante.

Un filtre se décompose en trois parties :

- Le Field : la donnée que l’on va requêter

- L’Operator : l’opérateur qui permet de filtrer le champ

- La Value : la valeur que doit prendre l’opérateur pour la donnée

NB : il existe deux options lorsque l’on travaille sur des champs en chaine de caractère qui permettent de forcer la casse ou utiliser les expressions régulières sur le filtre. Nous n’aborderons pas le concept des RegEx dans cet article.

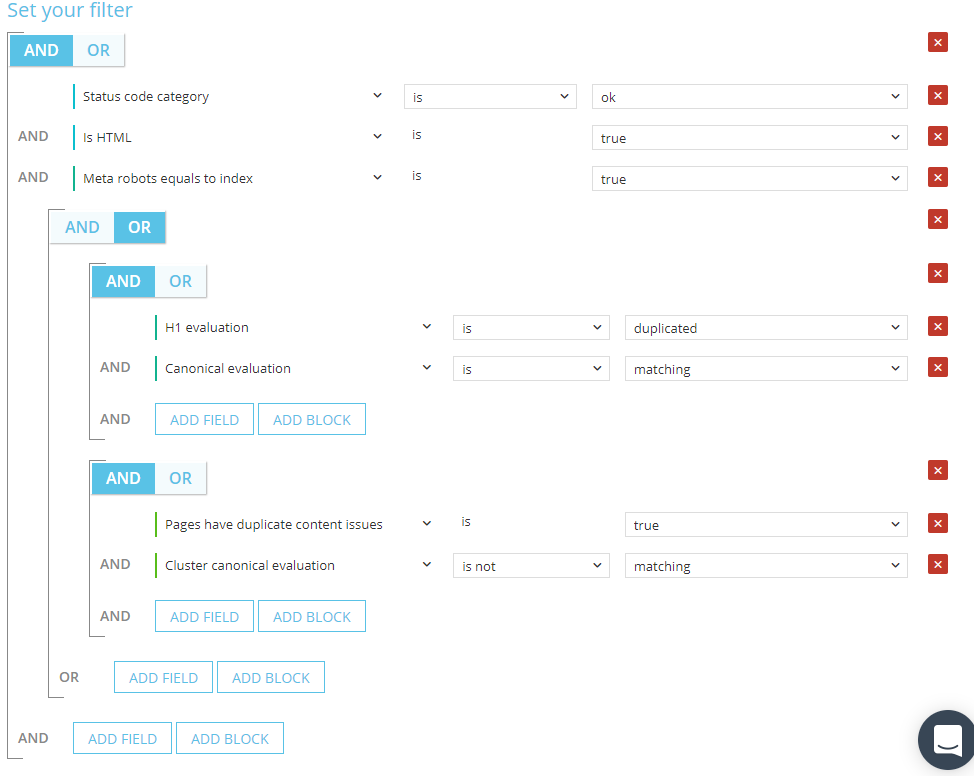

Vous avez peut-être constaté qu’il existe deux types d’agrégation des séquences – lignes – des filtres : le AND et le OR. Cette fonctionnalité est un moyen de créer des ensembles inclusifs ou exclusifs dans le requêtage des données.

Par défaut les opérateurs logiques entre les filtres sont des AND, mais il est aussi possible d’utiliser des OR, ce qui permet de comparer des urls d’ensembles différents. C’est à vous de juger du type d’agrégation la plus pertinente pour vos données.

Ceci s’applique entre chaque ligne du filtre, mais encore une fois vous avez surement déjà remarqué qu’il est possible de créer des blocs. Les OR et les AND peuvent donc être très intéressants dans ce contexte.

Comment créer un Filtre Custom from scratch ?

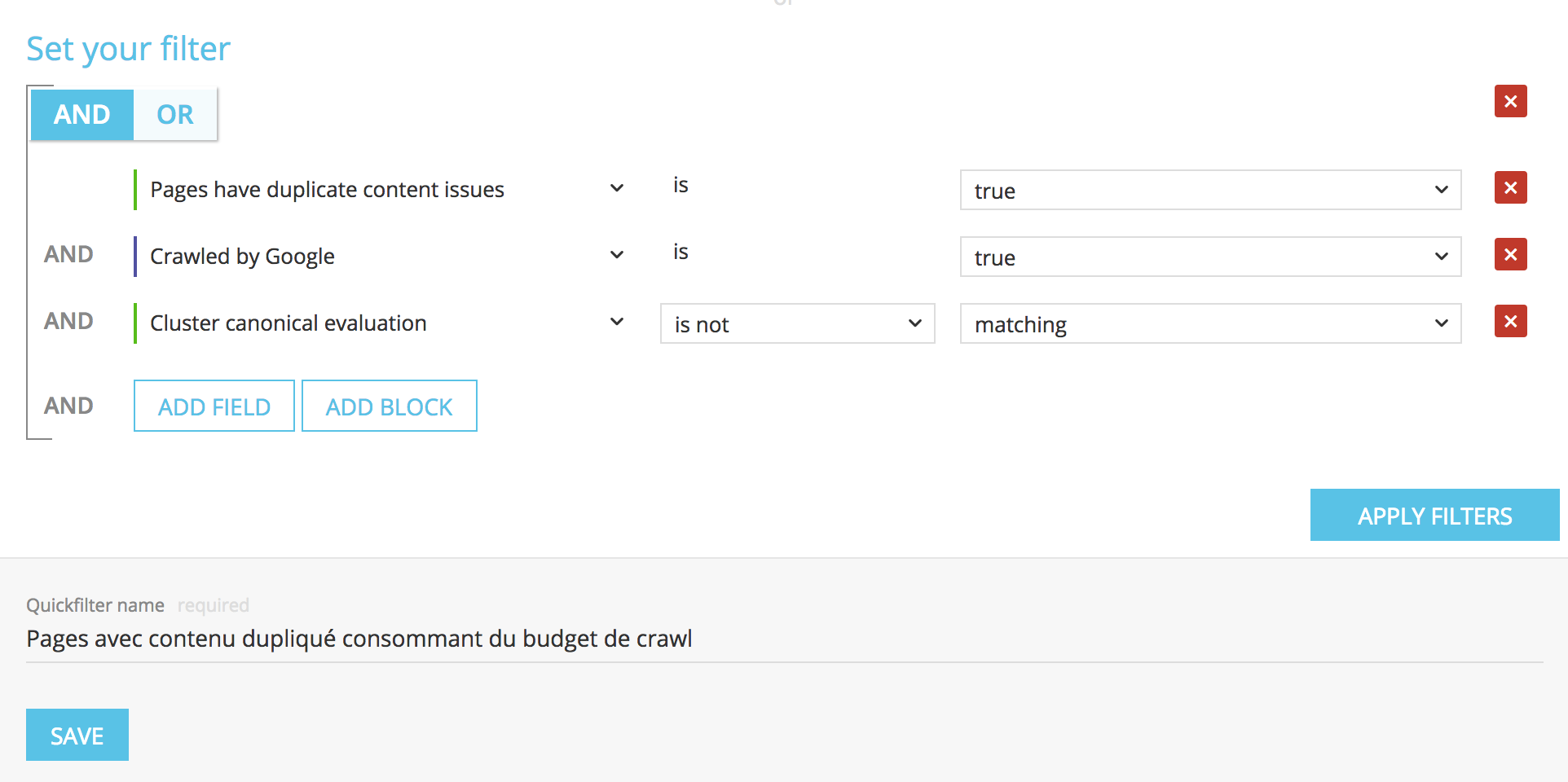

Prenons un exemple concret. Sélectionnez toutes les pages qui sont dupliquées, crawlées par Google et dont le titre contient une expression particulière :

Cela revient à créer un filtre en 3 étapes :

- “Pages with duplicate content issues” is true

- “Crawled by Google” is true

- “Title” contain [mon expression]

Cet exemple simple permet de comprendre comment les données peuvent être filtrées. Cela doit déjà vous donner envie de croiser des métriques.

Comment aller plus vite pour créer des Custom Filters ?

Vous pouvez partir de l’un des Quick filter pour créer votre propre Filter “Own Filter” en ajoutant des conditions dans le filtre et en le sauvegardant ensuite pour le récupérer rapidement lors de votre prochaine visite.

Par exemple, en partant des liens pointant vers une 4xx, vous pouvez choisir de filtrer sur les liens comportant une ancre vide : “Anchor“ / “is” / “” et sauvegarder ce filtre grâce au bloc suivant “Quick filter name” puis “Save” comme sur la capture ci-dessous.

Une fois enregistré, il peut être modifié à volonté puis re-enregistré sous le même nom, si besoin.

Vous avez maintenant accès à ce “Quick Filter” particulier directement dans la liste “Select a Quick Filter” tout en bas dans la partie “Own” comme sur la capture ci-dessous.

Les 17 Filtres Custom à connaître

Après toutes ces explications vous devez avoir envie de connaître nos 17 Custom Filters les plus appréciés des nos power users. Le suspens est terminé, les voici :

Ils sont séparés en deux groupes, pour les utilisateurs de projets Basics et des projets Advanced (avec analyse de logs et croisement de données)

Filtres custom basiques

Vérification d’indexabilité importante

- Pages ne pouvant pas être indexées ou crawlées.

Il est important de vérifier qu’aucunes de vos pages importantes ne sont dans cette liste.

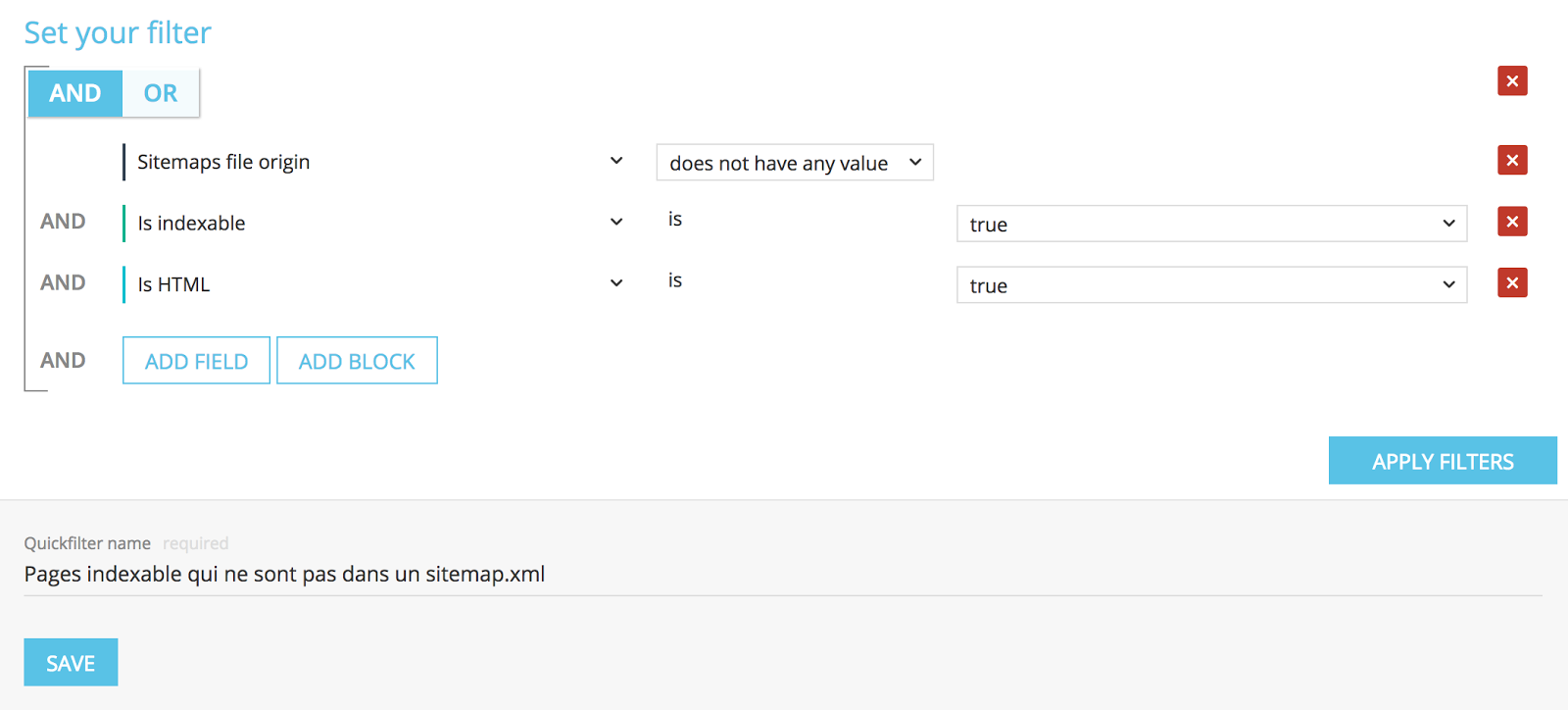

- Pages indexables qui ne sont pas dans un sitemap.xml.

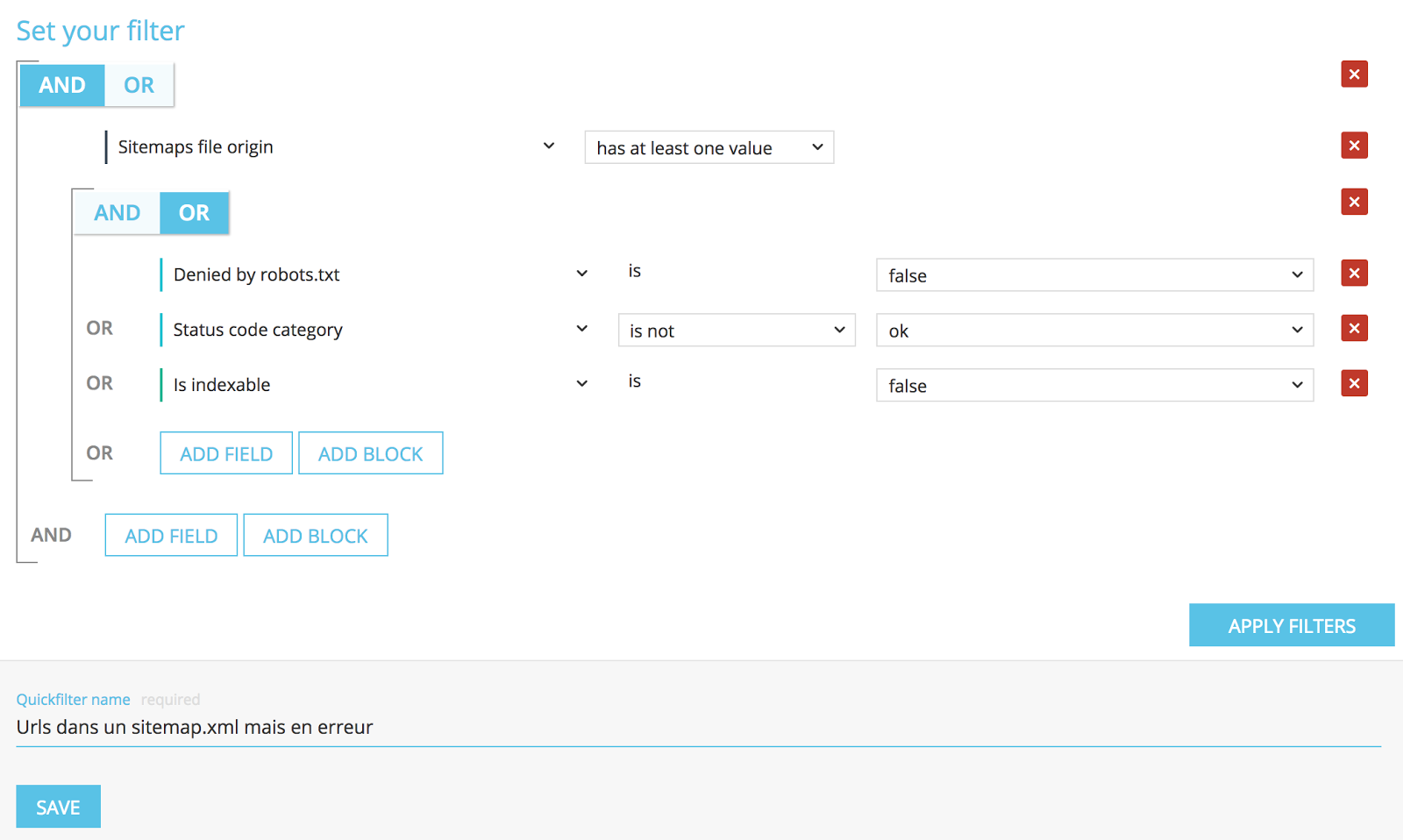

- Pages dans un sitemap.xml mais pointant vers des pages en erreur.

Contenus pauvres, dupliquées et canonique : Objectif, contrecarrer Google Panda

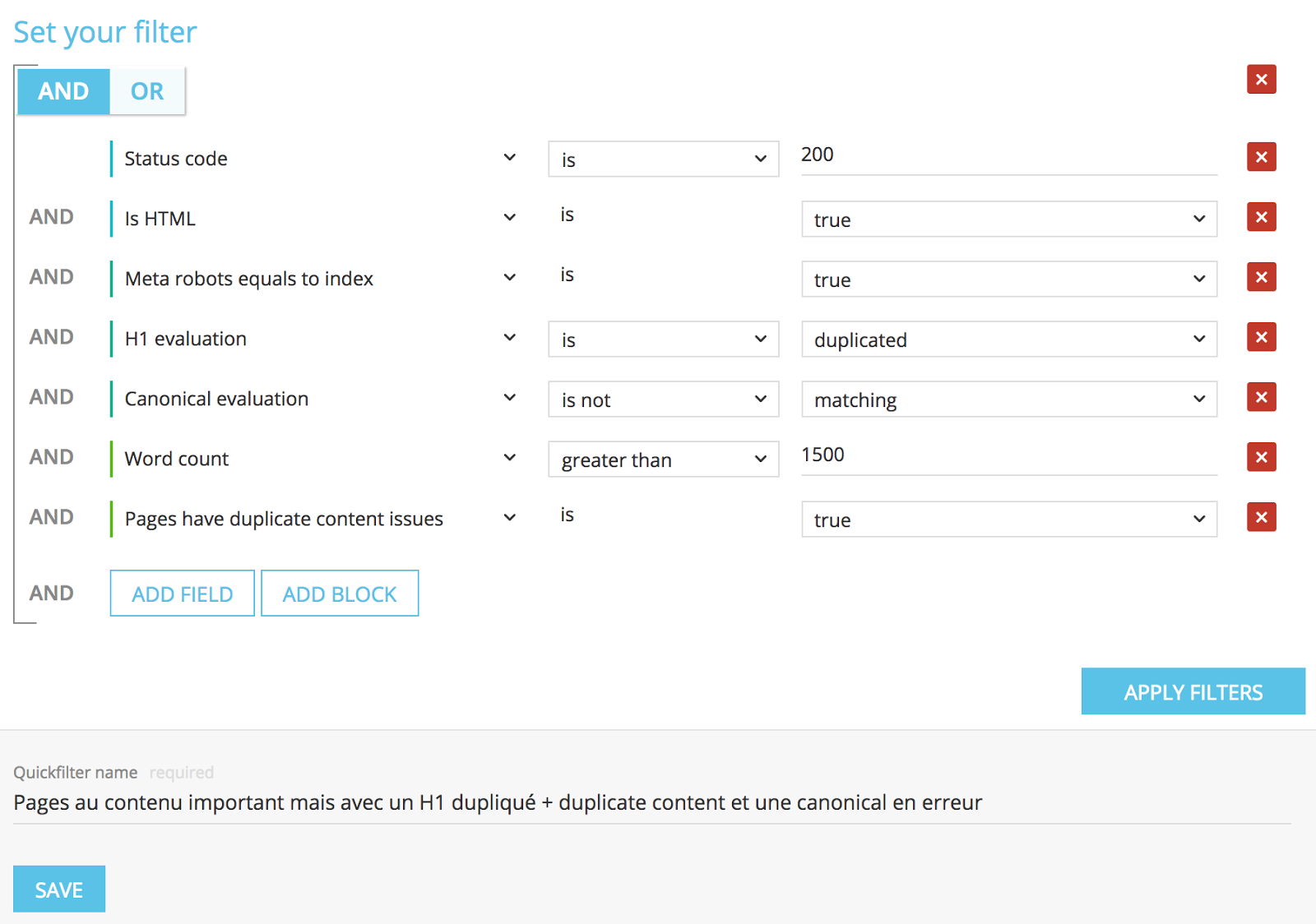

- Pages contenant du contenu important mais avec un H1 dupliqué, du contenu dupliqué et une canonique en erreur.

Vous constatez que les filtres “Status code is 200” + “is HTML is true” + “Meta robots equals to index is true” peuvent être importants pour vous concentrer sur vos pages indexables.

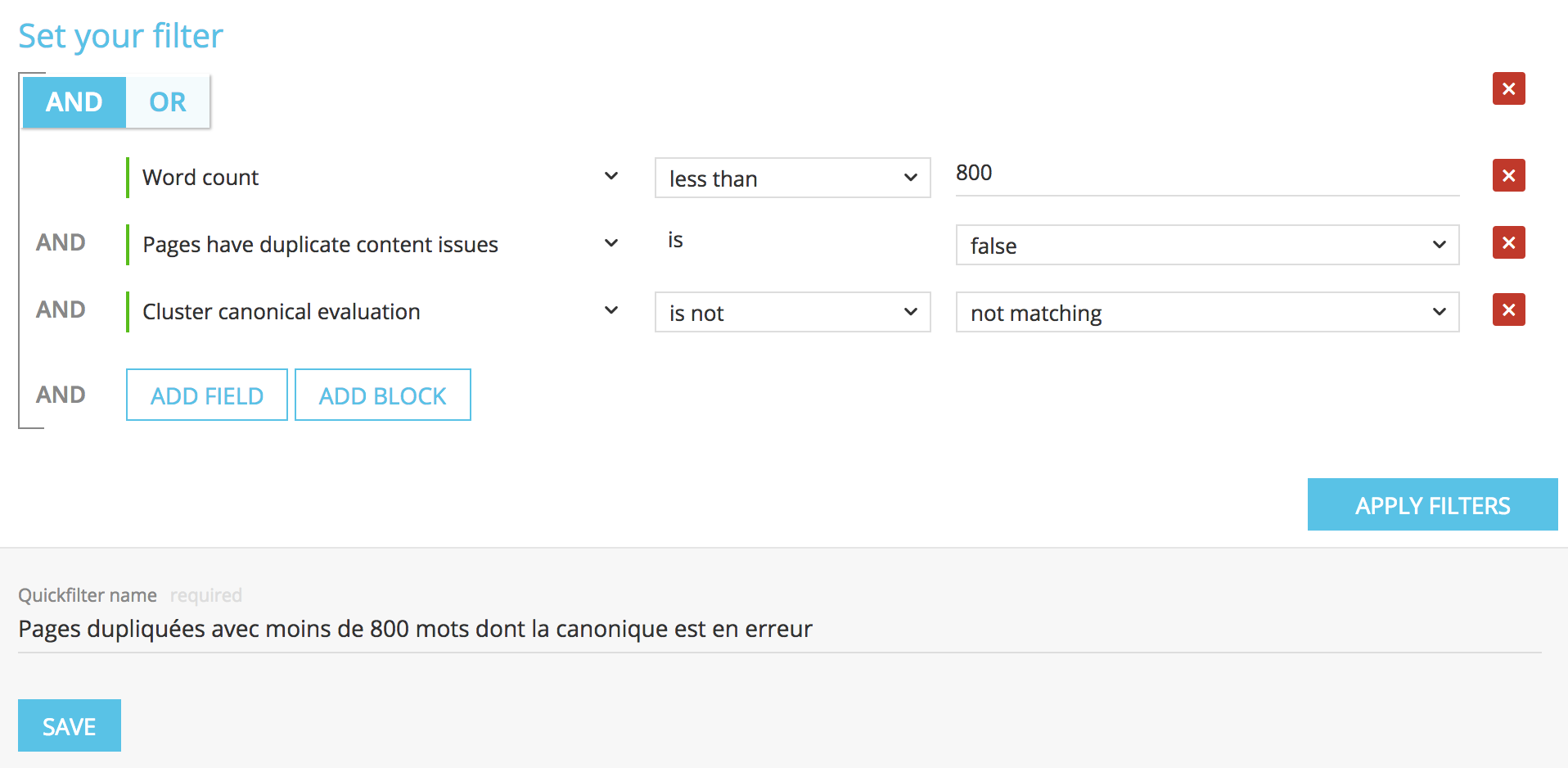

- Pages dupliquées avec moins de 800 mots dont la canonique est en erreur.

Faites bien attention à la séquence des opérateurs logiques lorsque vous utilisez les AND et OR.

Pro tip : ajoutez les colonnes Ngrams et Similar pages pour avoir une analyse plus poussée.

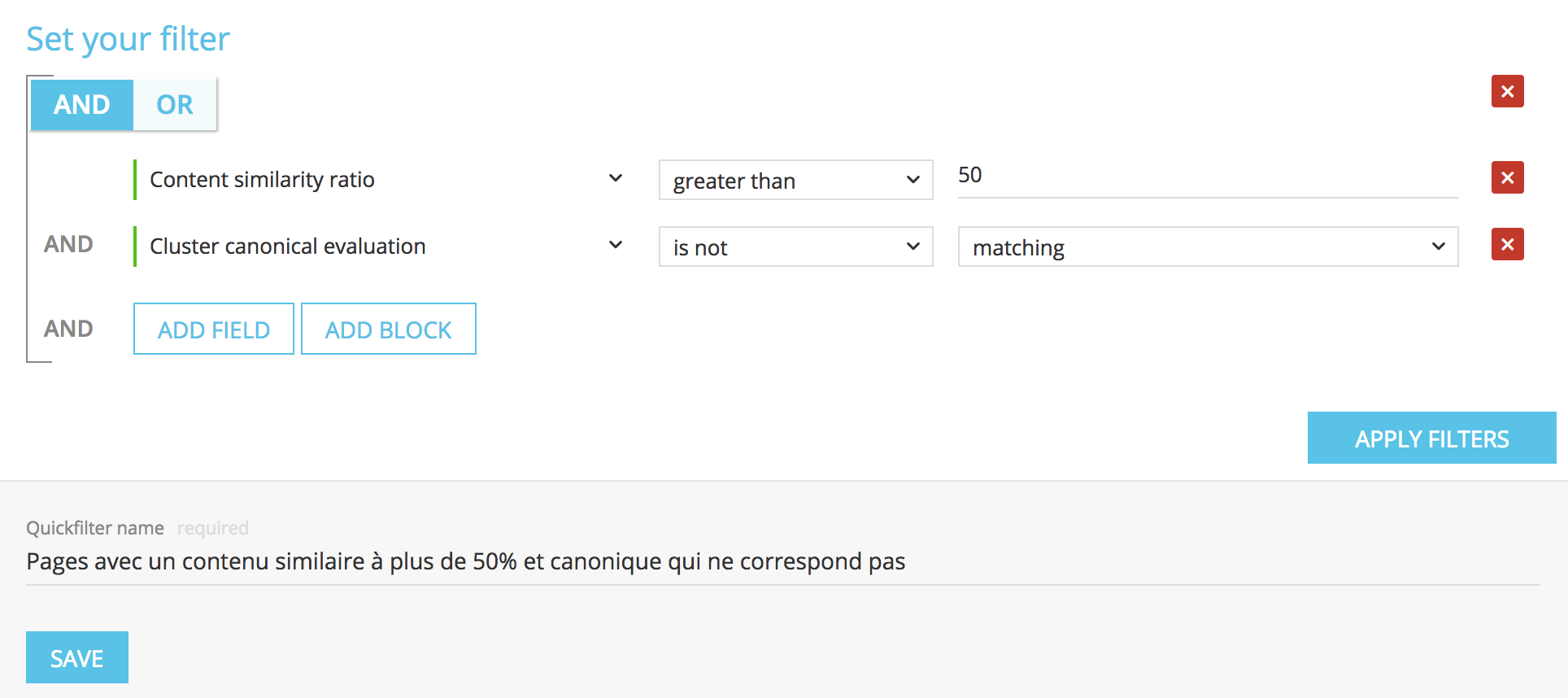

- Pages avec un contenu similaire à plus de 50% et canonique qui ne correspond pas.

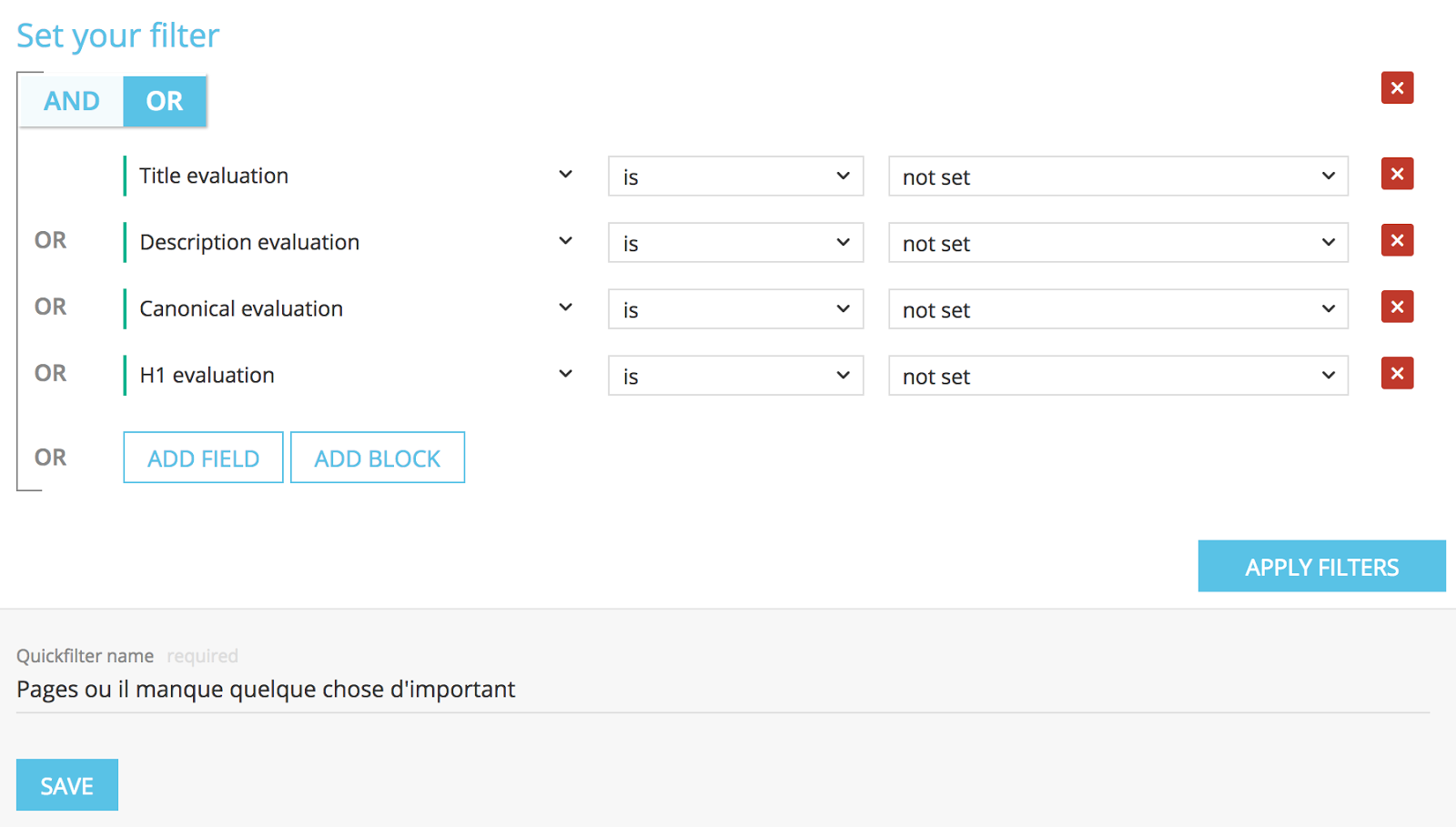

- Pages où les balises SEO importantes sont manquantes ou vides.

Maillage interne : Objectif, contrecarrer Google Penguin

Le maillage interne joue pour beaucoup dans votre capacité à diffuser la popularité de vos pages vers certaines autres pages essentielles et favoriser leur ranking. Pensez à faire quelques vérifications de base.

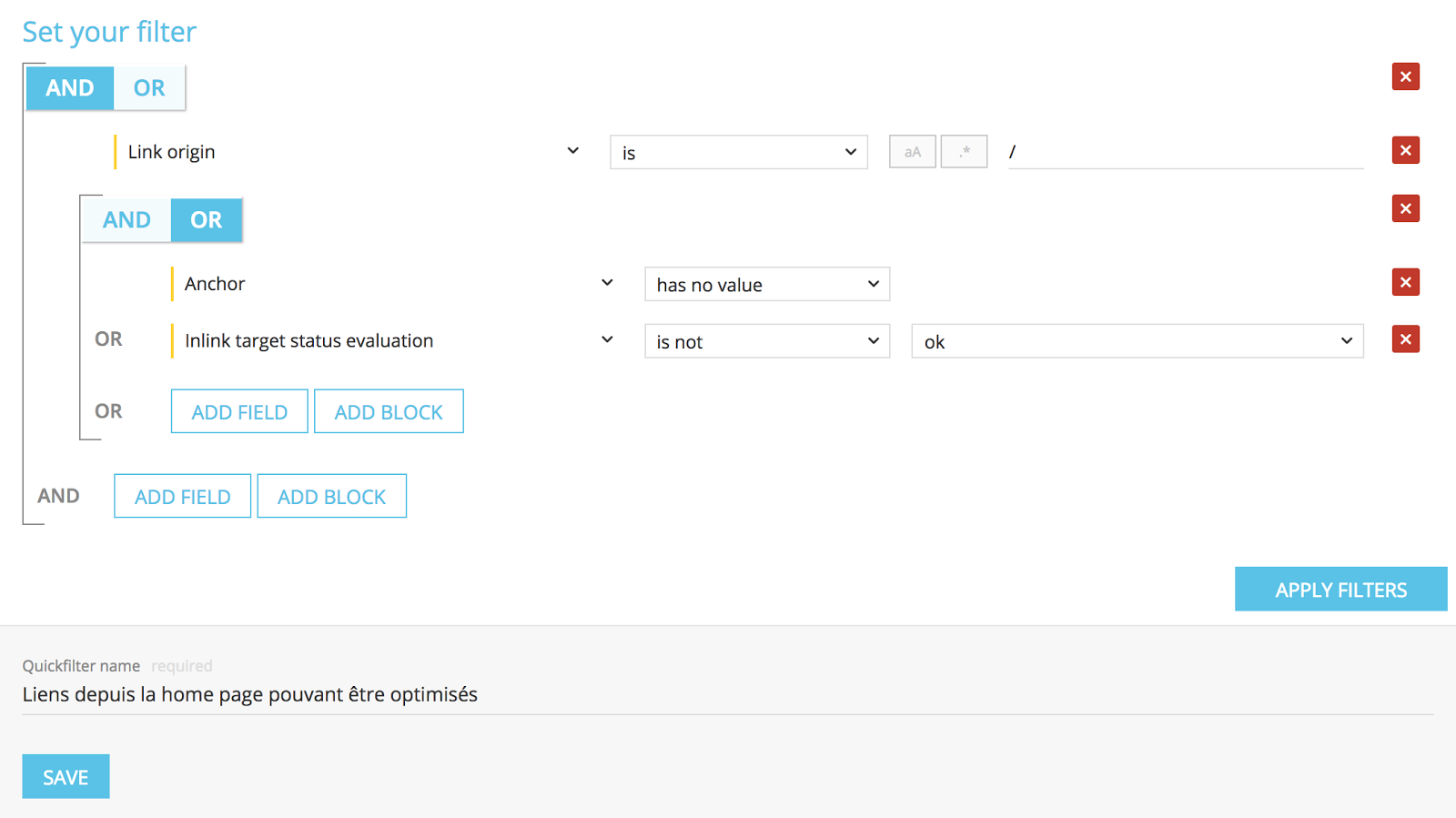

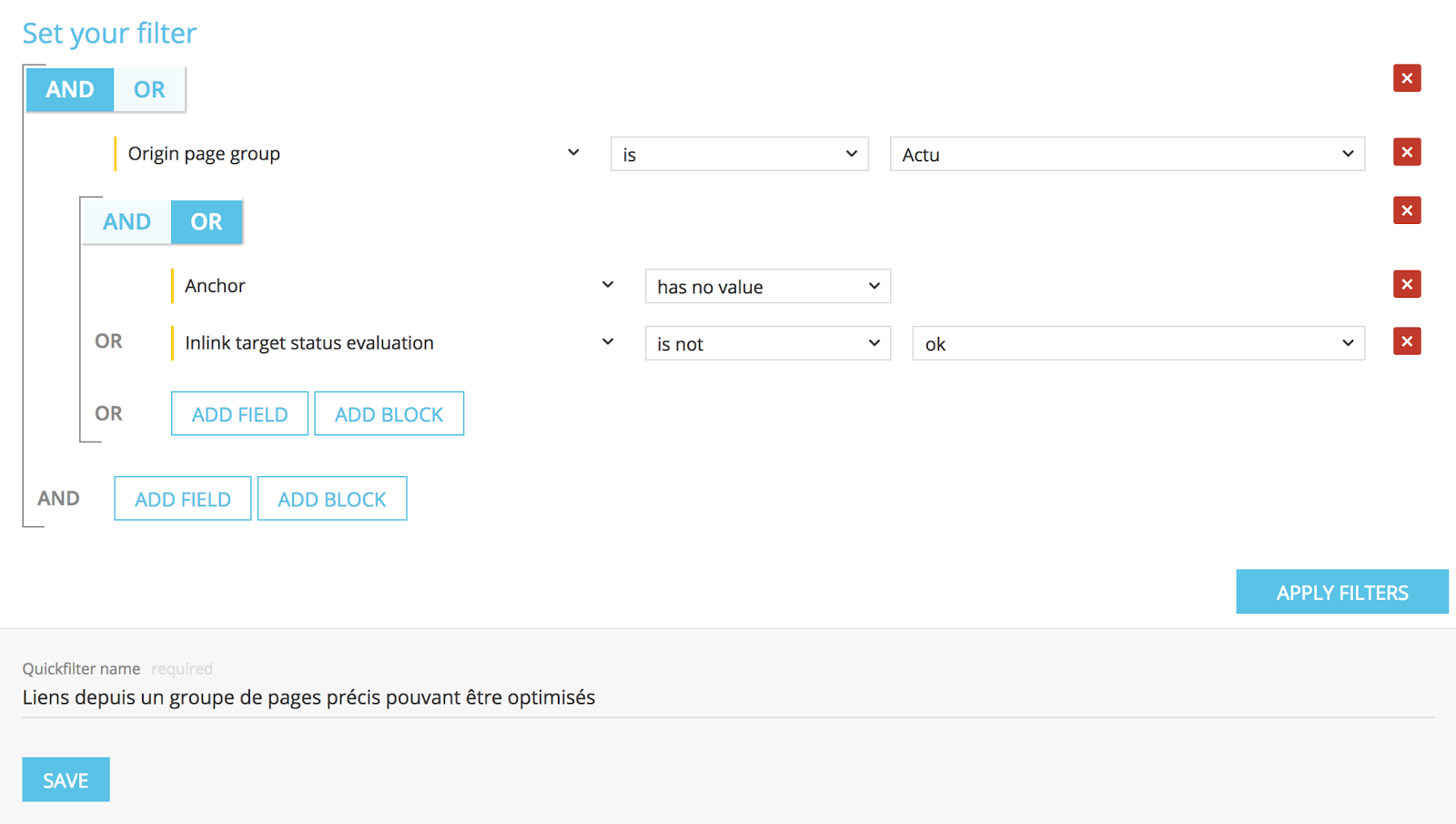

- Liens depuis la page d’accueil pouvant être optimisés.

- Liens pouvant être optimisés depuis un groupe de pages précis.

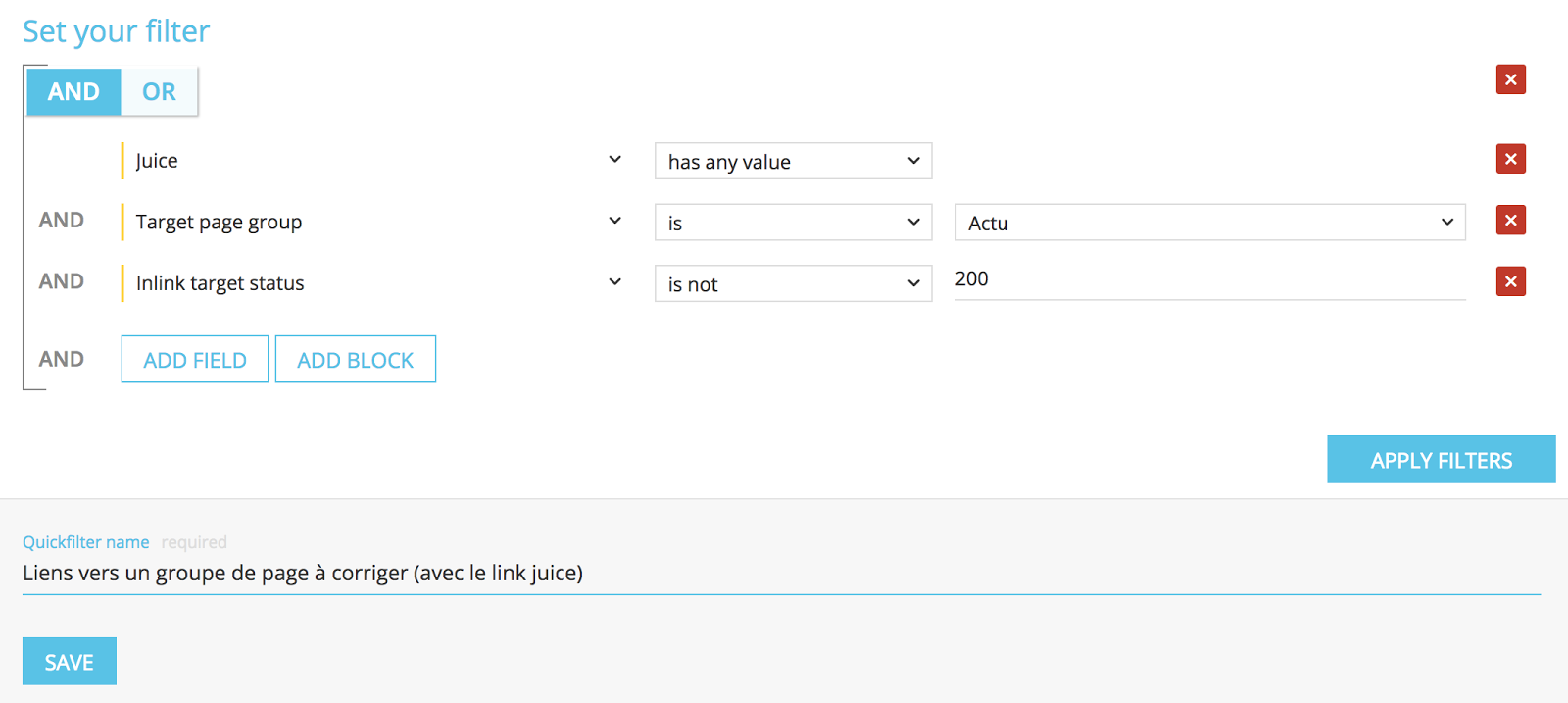

- Liens vers un groupe de page à corriger (avec le jus de lien).

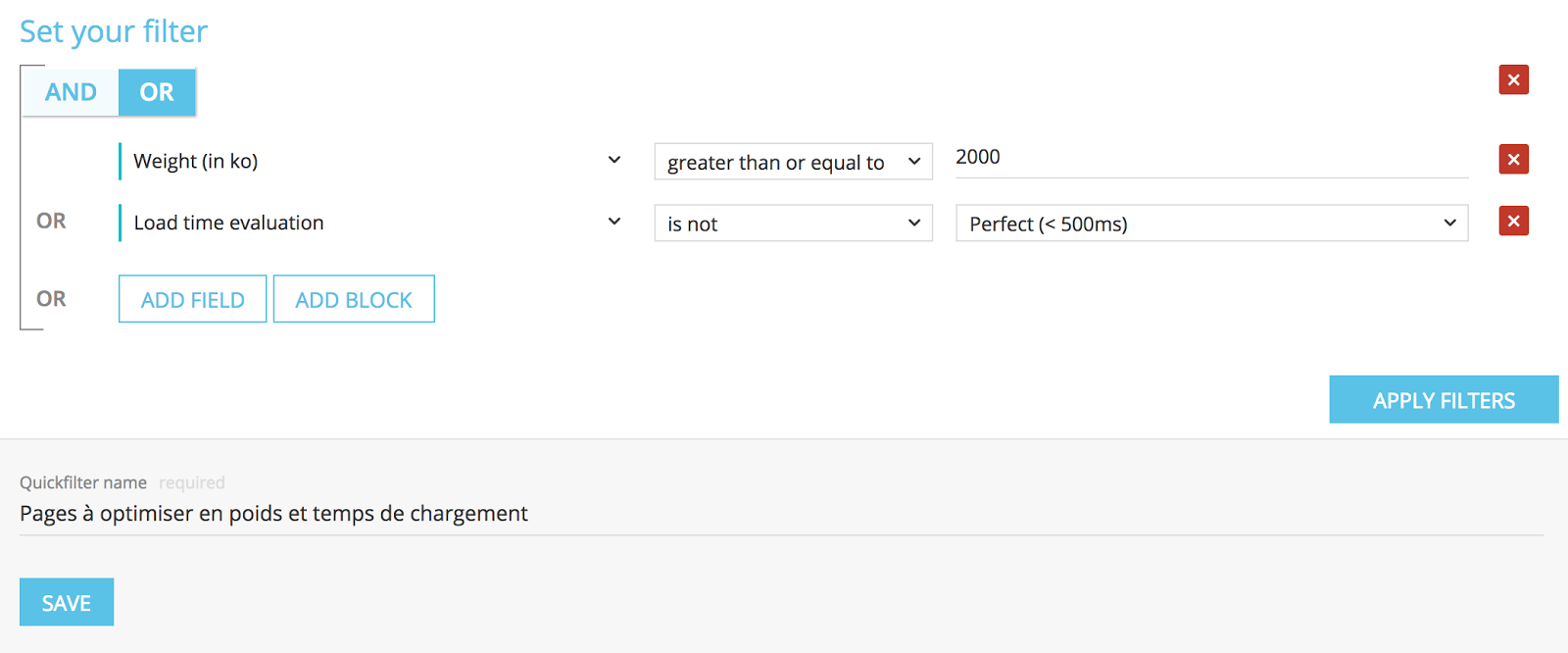

- Pages à optimiser en poids et temps de chargement.

Filtres Custom Advanced

L’avantage des projets Advanced est de pouvoir croiser les données issues de vos logs et ainsi affiner vos études pour explorer des segments de pages importantes – avec un taux de visites important – ou au contraire avec un trop faible taux de visites des crawlers.

Voici les Customs Fields les plus en vue à l’heure actuelle sur Oncrawl pour ce type de projets :

PRO TIP : Pour la partie budget de crawl nous vous invitons à toujours afficher les colonnes liées à “Google” dans le Data Explorer.

- Pages avec contenu dupliqué consommant du budget de crawl.

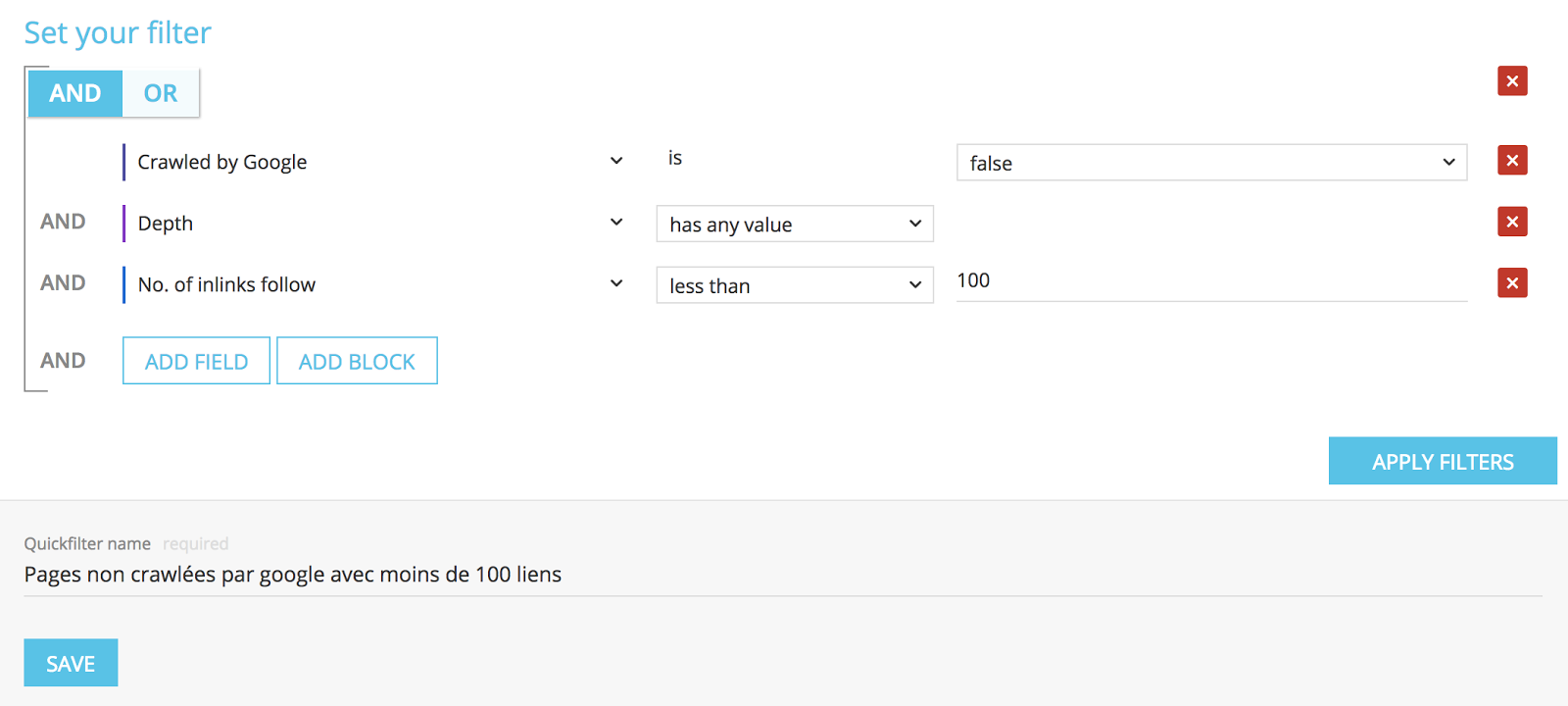

- Pages non crawlées par Google avec moins de 100 liens.

À vous d’adapter le seuil du nombre de liens à étudier.

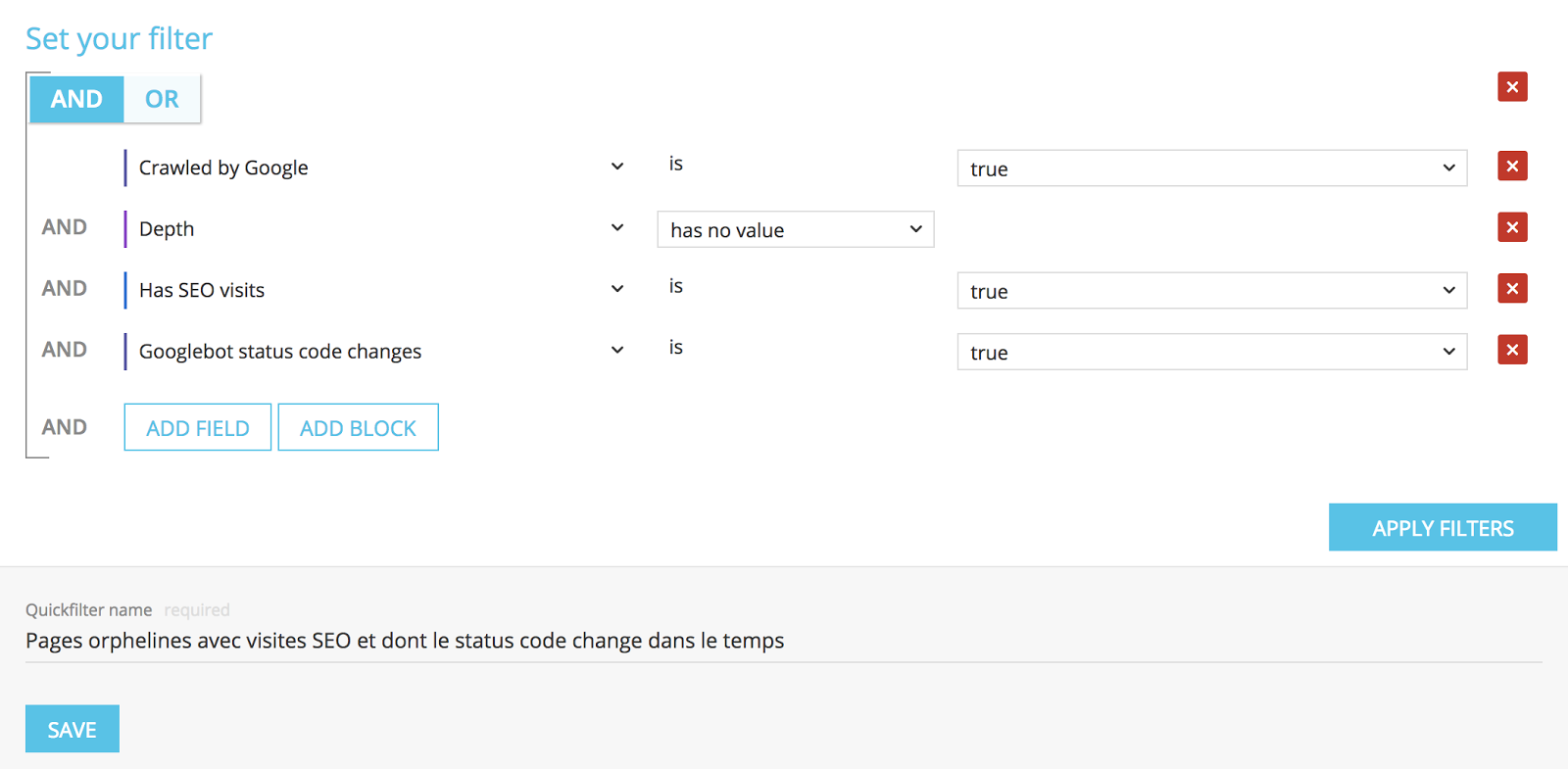

- Pages orphelines avec visites SEO et dont le status code change dans le temps.

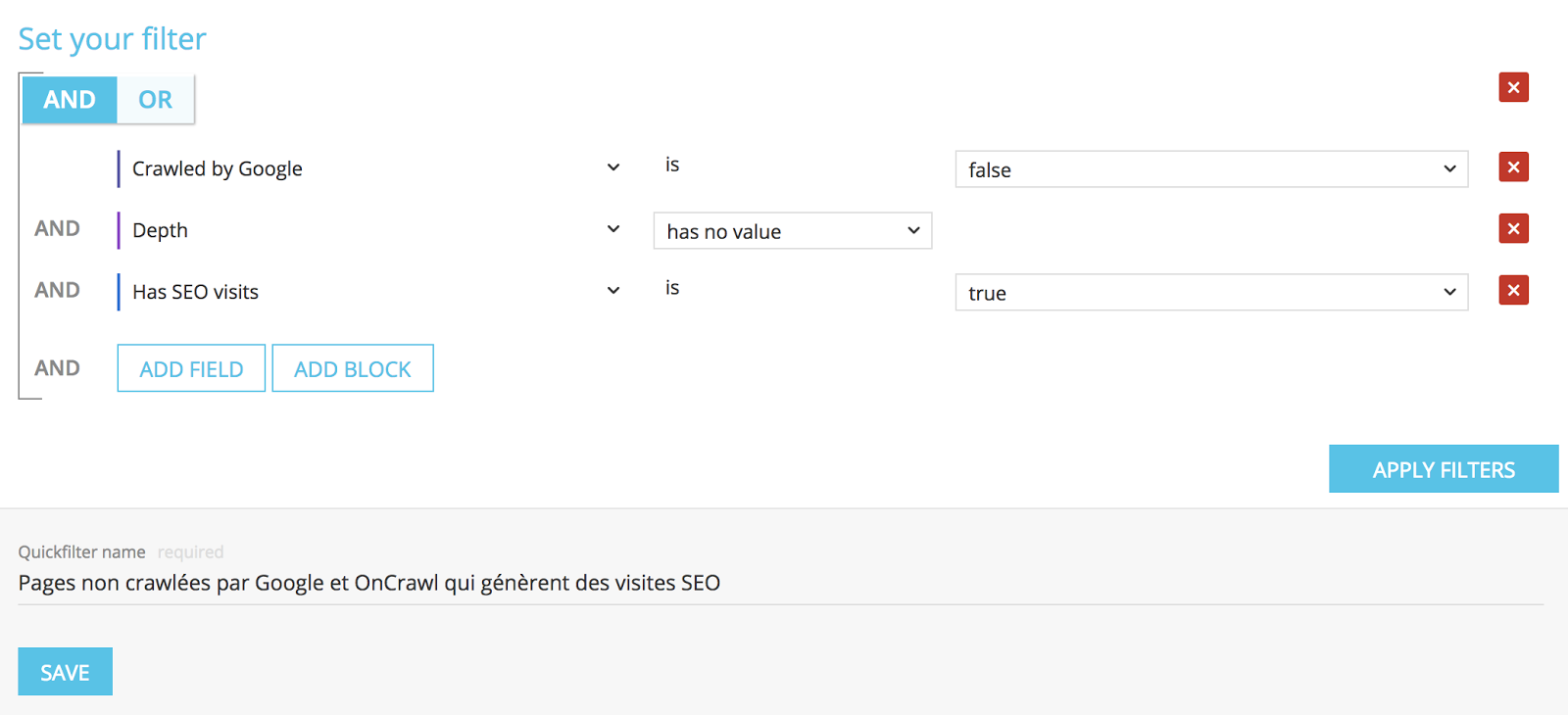

- Pages orphelines non crawlées par Google et Oncrawl mais qui génèrent des visites SEO (oui c’est possible)

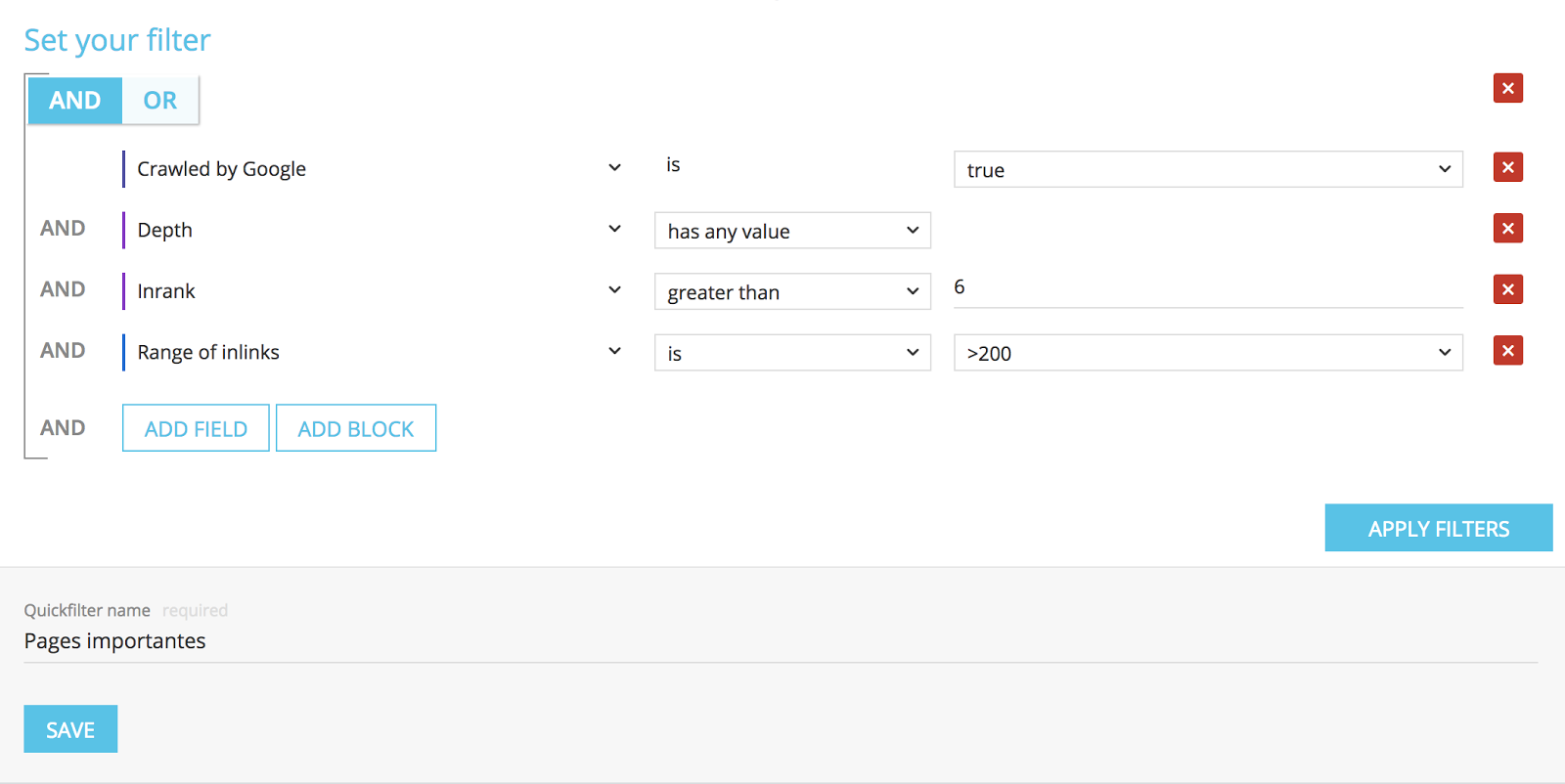

- Les pages importantes (plus d’info sur l’article dédiée à la Page Importance de Google).

PRO TIP : Bien séparer les pages avec et sans visites SEO en affichant la colonne “Has SEO visits” issues de Google et les classer de la plus visitée par Google (souvent la page d’accueil). Ces pages sont vos meilleures pages pour créer du maillage interne puissant.

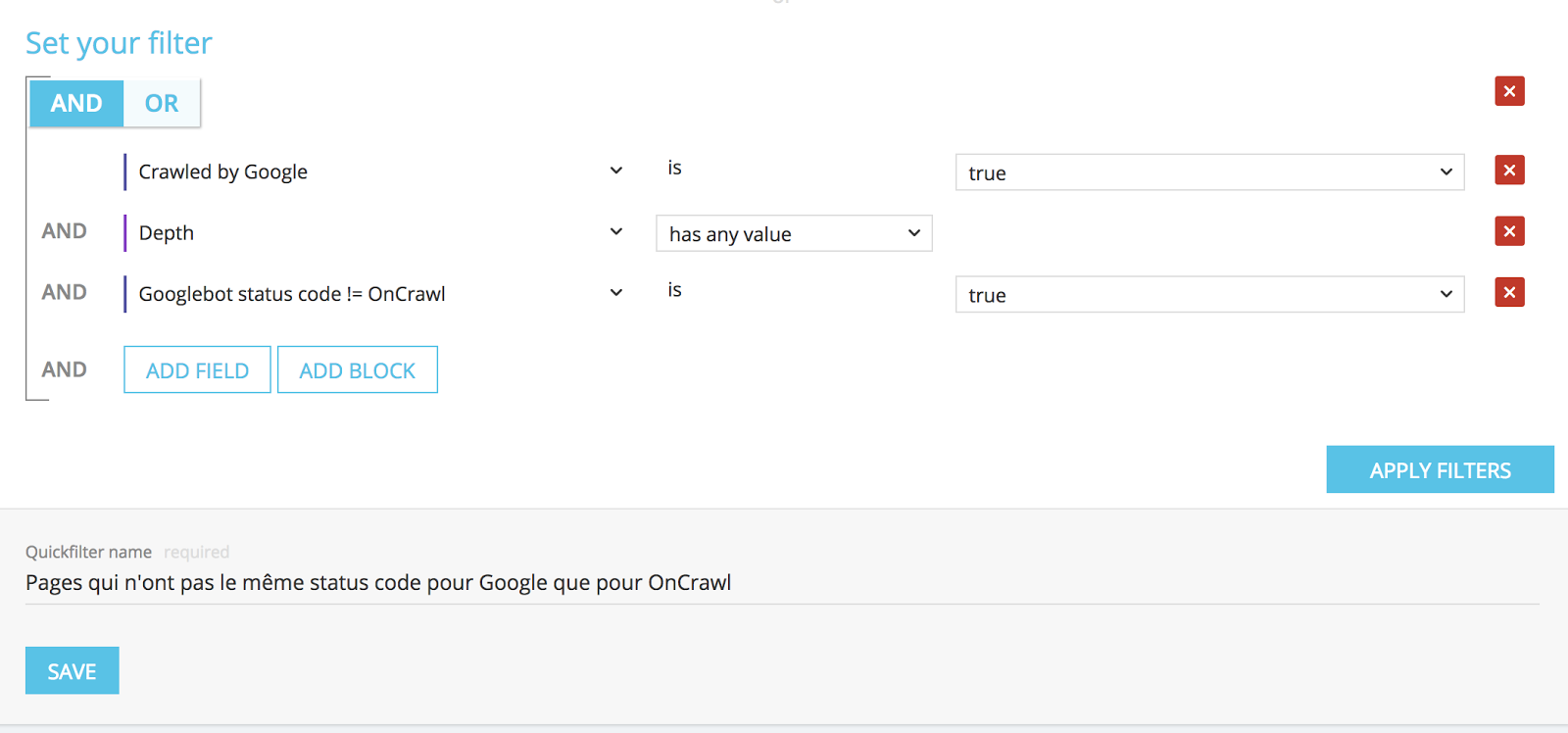

- Pages qui n’ont pas le même status code pour Google que pour Oncrawl.

Ces exemples ne sont qu’une toute petite partie de ce qu’il est possible de faire, ils viennent enrichir les filtres créés par les graphiques d’Oncrawl lors de votre navigation dans l’application et les QuickFilter.

Conclusion

Les Custom Filters d’Oncrawl sont extrêmement puissants et appréciés par nos utilisateurs car ils permettent grâce à l’export CSV de créer des ensembles de données qui peuvent être traités dans d’autres outils comme R-studio, Tableau ou Excel pour ne citer qu’eux.

C’est aussi le premier pas à l’intégration de notre API car vous êtes en train de manipuler notre langage de requête OQL. Nous avons déjà des connecteurs Google Spreadsheet par exemple.

Les possibilités sont quasiment sans limites, c’est à vous de créer vos filtres en fonction de vos besoins, et n’hésitez pas à les partager avec nous et la communauté Oncrawl. Nous serons enchantés de pouvoir les incorporer dans les prochaines versions de l’application s’ils sont pertinents.

L’utilisation du Data Explorer et de ses filtres peut être complexe pour un utilisateur peu aguerri. Mais ne vous inquiétez pas, il vous suffit d’un peu d’entraînement pour manipuler avec efficacité les filtres Oncrawl.

Nos Customers Success Manager sont là pour vous accompagner dans votre démarche si besoin, contactez-les grâce au chat de l’application.

À vous de jouer maintenant !