L’analyse de fichiers de logs vous aide à comprendre la manière dont les moteurs de recherche crawlent un site et leur impact sur le SEO. Les informations qui en ressortent sont d’une grande aide pour améliorer votre habilité à être crawlé et vos performances SEO.

Avec ces données, vous pouvez analyser le comportement du crawl et en faire ressortir des métriques intéressantes comme:

- Est-ce que votre budget de crawl est dépensé de manière efficace ?

- Quelles erreurs liées à l’accessibilité ont été rencontrées pendant le crawl ?

- Où sont situées les zones de carence de crawl ?

- Quelles sont les pages les plus actives ?

- Quelles sont les pages que Google ne connaît pas ?

Le fait est que vous pouvez également faire cette analyse gratuitement. Oncrawl fournit ainsi un analyseur de log en open source.

Cela vous aidera à détecter:

- Les pages uniques crawlées par Google

- La fréquence de crawl par groupe de pages

- Les statuts codes

- les pages actives et inactives

Comment ça marche ?

1- Installez Docker

Installez Docker Tool Box.

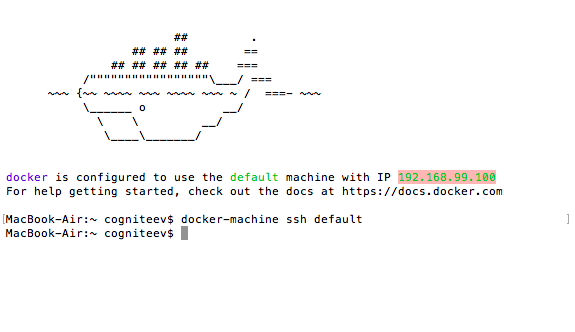

Sélectionnez le terminal Docker Quickstart pour commencer.

Copiez/collez l’adresse IP 192.168.99.100

Ensuite, téléchargez la publication oncrawl-elk: https://github.com/cogniteev/oncrawl-elk/archive/1.1.zip

Ajoutez ces lignes dans le terminal pour créer un répertoire et dézipper le dossier:

- MacBook-Air:~ cogniteev$ mkdir oncrawl-elk

- MacBook-Air:~ cogniteev$ cd oncrawl-elk/

- MacBook-Air:oncrawl-elk cogniteev$ unzip ~/Downloads/oncrawl-elk-1.1.zip

Et ensuite, ajoutez:

- MacBook-Air:oncrawl-elk cogniteev$ cd oncrawl-elk-1.1/

- MacBook-Air:oncrawl-elk-1.1 cogniteev$ docker-compose -f docker-compose.yml up -d

Docker-compose téléchargera toutes les images nécessaires depuis docker hub, cela prendra donc quelques minutes. Une fois que le récipient du docker a démarré, vous pouvez entrer l’adresse suivante dans votre navigateur: http://DOCKER-IP:9000. Faites attention à bien remplacer la DOCKER-IP par l’IP que vous avez copié auparavant.

Vous devriez voir le tableau de bord Oncrawl-ELK mais sans aucune donnée. Allons donc chercher des données à analyser.

2-Importez des fichiers de logs

L’importation de données est aussi simple que de copier les fichiers d’accès de logs dans le bon dossier. Logstash commencera à indexer automatiquement tout fichier trouvé sur logs/apache/*.log , logs/nginx/*.log.

Si votre serveur web est alimenté par Apache ou NGinx, assurez vous que le format soit adapté au format de logs. Cela devrait ressembler à:

127.0.0.1 — — [28/Aug/2015:06:45:41 +0200] “GET /apache_pb.gif HTTP/1.0” 200 2326 “http://www.example.com/start.html” “Mozilla/5.0 (compatible; Googlebot/2.1; +http://www.google.com/bot.html)”

Déposez vos fichiers de logs dans logs/apache ou le répertoire logs/nginx en conséquence.

3-Jouez !

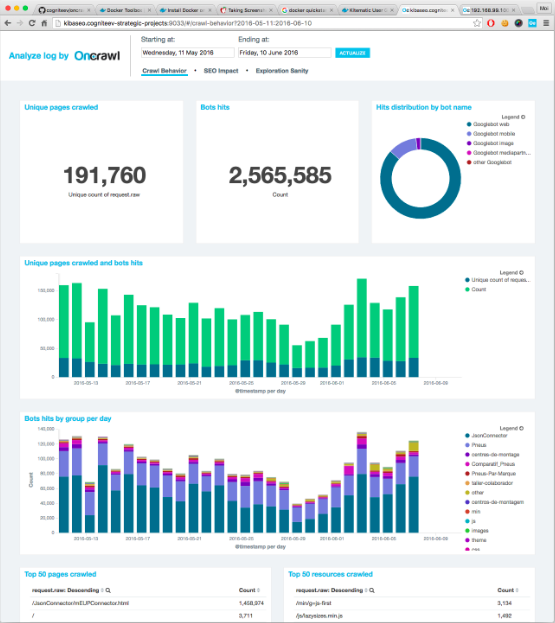

Retournez sur http://DOCKER-IP:9000. Vous devriez maintenant avoir des chiffres et des graphiques, félicitations !

Vous pouvez également combiner ces données avec vos données de crawl et avoir accès à une vue complète de votre performance SEO. Vous serez également capable de détecter les pages orphelines actives, de vérifier le ratio de crawl par profondeur ou groupe de pages et plein d’autres informations intéressantes. Pour en savoir plus sur l’analyse croisée, vous pouvez jeter un coup d’oeil à cette page.

Bonjour,

Je n’arrive pas à importer d’autres fichiers de logs. J’ai supprimé un fichier de logs pour en mettre un autre à la place, et j’ai toujours les données de l’ancien.

Merci d’avance por votre réponse

« Docker Tool Box » n’existe pas, je suppose qu’il faut choisir Docker Community Edition ?

Je l’ai installé sur mon mac mais ensuite je ne comprends pas ce que signifie « Sélectionnez le terminal Docker Quickstart pour commencer. »

Bref, votre tuto mériterait une petite mise à jour ou bien des explications complémentaires.

Merci d’avance !

Bonjour

Cela ne marche pas sous Windows 10. C’est un problème Docker (partage du disque C via Samba qui ne se fait pas). Dommage car cela avait l’air intéressant …