Lors du SMX Paris 2026, avec Maxime Guernion (Head of SEO d’Havas Market), nous avons abordé le crawl des IA sous le prisme de comprendre ce que les IA faisaient de votre contenu, avec le constat que votre data n’est plus vraiment la vôtre…

Ce constat, je le vois se dessiner dans les logs depuis quelques mois. Depuis plus de 15 ans, j’analyse des logs serveur : des milliards de lignes. Googlebot, Bingbot, et tous leurs cousins. Chaque passage sur une URL laisse une empreinte sur le serveur, ce qui permet de savoir ce que les moteurs de recherche font réellement sur un site, loin de ce qu’ils prétendent faire.

Aujourd’hui, de nouveaux acteurs débarquent dans ces logs. GPTBot, ClaudeBot, PerplexityBot, OAI-SearchBot, et une dizaine d’autres. Ils crawlent massivement, et la plupart des équipes SEO ne savent pas exactement ce qu’ils font sur leur site.

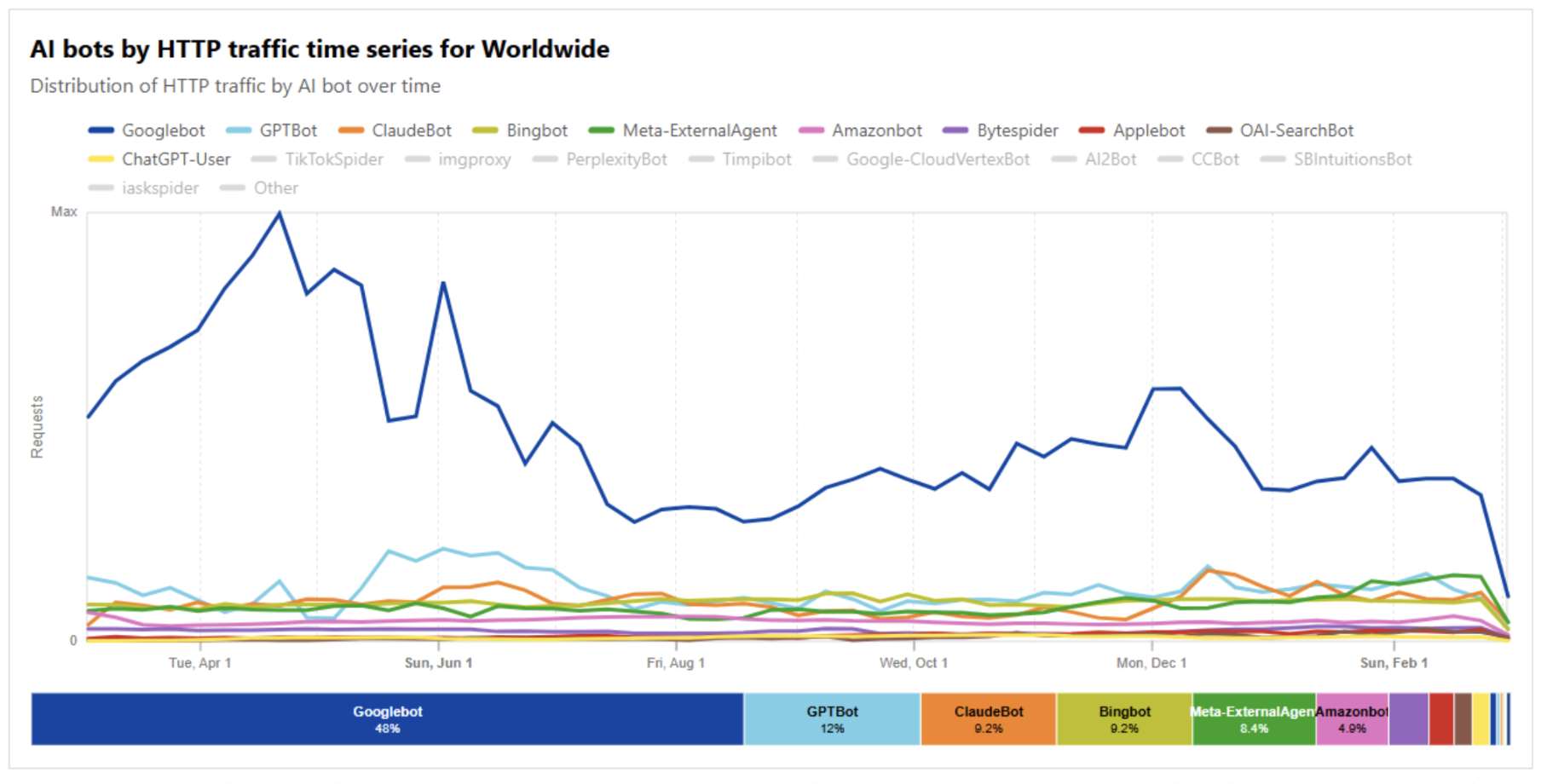

Les chiffres parlent d’eux-mêmes : selon les données Cloudflare Radar sur les 12 derniers mois (mars 2025 à mars 2026), GPTBot et ClaudeBot représentent respectivement 12% et 9,2% du trafic bot mondial. ClaudeBot est désormais au même niveau que Bingbot, et les trois sont juste derrière Googlebot (48%). En l’espace d’un an, les bots IA sont passés de signaux faibles à acteurs majeurs du crawl.

Figure 1 — Distribution du trafic bots sur 12 mois : Googlebot 48 %, GPTBot 12 %, ClaudeBot 9,2 %, Bingbot 9,2 %. Source : Cloudflare Radar, monde.

Pourtant, quand j’échange avec des équipes SEO, même des profils seniors, le constat est souvent le même : on sait que les IA crawlent, on ne sait pas vraiment ce qu’elles en font. Et surtout, on ne sait pas quoi en faire…

Cet article est une tentative de clarification : j’y partage ce que j’observe sur le terrain, chez mes clients, dans les logs, dans les robots.txt, et dans les comportements parfois erratiques de ces nouveaux crawlers. L’objectif n’est pas de faire peur ni de vendre du rêve : c’est de poser les bases pour comprendre ce qui se passe réellement.

Cartographie : qui crawle quoi, et pourquoi

Quand on parle de « bots IA », on met souvent tout dans le même panier : c’est une erreur. Tous les bots IA ne font pas la même chose, et les confondre peut mener à de mauvaises décisions.

En analysant la documentation des principaux acteurs du marché et en analysant les logs de plusieurs dizaines de sites sur les 12 derniers mois, il faut comprendre qu’il existe quatre grandes typologies de bots LLM, avec des fonctions bien différentes.

Les bots d’apprentissage (Training)

Leur mission : aspirer du contenu web pour améliorer les modèles. GPTBot (OpenAI) et ClaudeBot (Anthropic) sont les plus connus.

Ils crawlent à grande échelle, souvent sans logique apparente de priorisation par rapport à la structure de votre site. OpenAI le dit clairement dans sa documentation :

« GPTBot est utilisé pour explorer du contenu susceptible d’être utilisé pour entraîner nos modèles fondamentaux d’IA générative. »

C’est du crawl de moisson, pas du crawl d’indexation.

[Ebook] Maîtriser le SEO dans un monde de Query Fan-Out

Les bots de recherche (Search)

Ceux-là se rapprochent davantage de ce que fait Googlebot : ils crawlent pour indexer et identifier les sources potentielles de réponses dans les moteurs IA.

OAI-SearchBot (OpenAI), Claude-SearchBot (Anthropic), PerplexityBot en font partie. C’est une distinction fondamentale : bloquer OAI-SearchBot dans votre robots.txt, c’est potentiellement disparaître des résultats de ChatGPT Search. Bloquer GPTBot, c’est refuser l’entraînement. Ce n’est pas le même choix stratégique.

D’ailleurs Claude-SearchBot est plutôt récent, et de nombreux sites médias qui restreignent ces types de bots ne le bloquent pas encore. Il est nécessaire de veiller au grain pour détecter ces nouveaux agents, pour les restreindre (ou non) en amont.

Les bots d’interaction (Fetch)

ChatGPT-User, Claude-User, Perplexity-User : ces bots récupèrent des données en temps réel, à la demande d’un utilisateur. Quand quelqu’un pose une question à ChatGPT et que le modèle a besoin d’une information fraîche, il envoie ChatGPT-User chercher la page.

Point important : comme OpenAI l’indique,

« Étant donné que ces actions sont initiées par un utilisateur, les règles du fichier robots.txt peuvent ne pas s’appliquer. »

Autrement dit, vos directives robots.txt ne sont pas forcément respectées par ces bots…

Les bots agentiques

C’est la catégorie la plus récente et la moins documentée. Ces bots agissent comme des utilisateurs : ils cliquent, scrollent, soumettent des formulaires, naviguent dans des interfaces.

On les voit de plus en plus dans les logs, et ils posent des questions inédites en termes de détection et de contrôle. C’est un sujet à surveiller de très près.

Aujourd’hui, quand je fais un audit, je ne regarde plus « le trafic bot IA » comme un bloc monolithique. Je segmente par typologie. Parce que la réponse à « faut-il bloquer les bots IA ? » n’est jamais oui ou non. C’est : lesquels, pour faire quoi, et avec quel impact.

Le mythe du contrôle : robots.txt, firewalls et réalité terrain

Beaucoup d’équipes SEO pensent avoir réglé le problème en ajoutant quelques lignes dans leur robots.txt. On aimerait que ce soit aussi simple.

Le robots.txt ne raconte qu’une partie de l’histoire

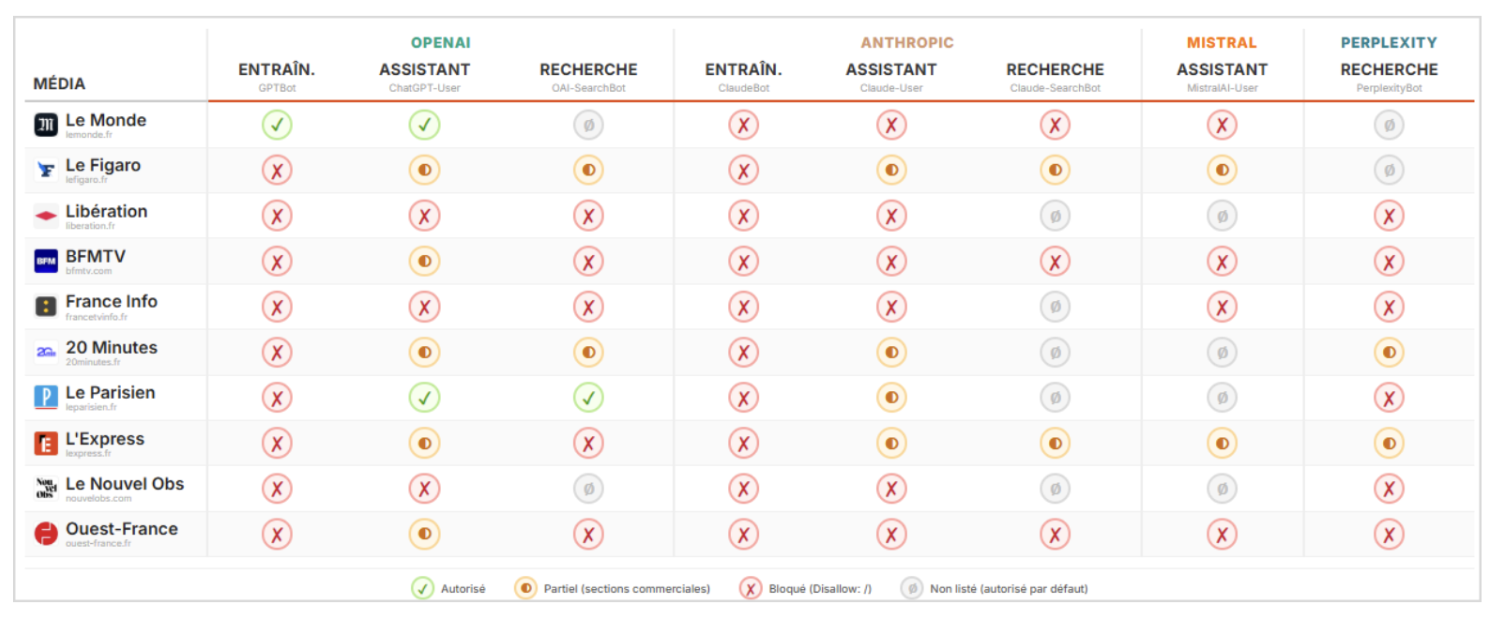

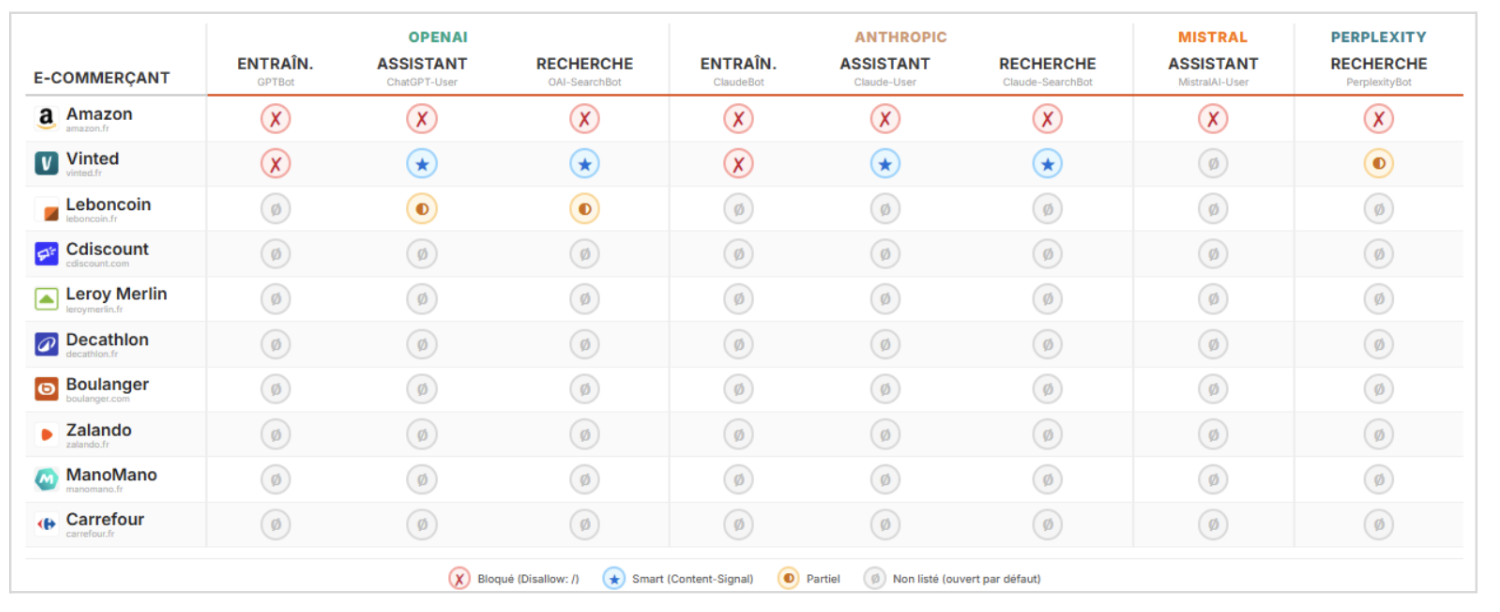

J’ai analysé les robots.txt d’un panel de sites médias et e-commerce français. Le constat est net : il n’y a pas de consensus.

Certains bloquent tout, d’autres autorisent tout (comme Le Monde dans le cadre d’un partenariat), beaucoup n’ont rien mis en place du tout. Et ceux qui bloquent ne bloquent pas tous les mêmes bots.

Figure 2 — Matrice de blocage des principaux bots IA sur les grands sites médias français. Le Monde autorise OpenAI dans le cadre d’un partenariat ; la majorité bloque tout ou laisse en défaut.

Figure 3 — Même exercice côté e-commerce français : quasiment tout est ouvert par défaut, à l’exception d’Amazon et Vinted (premier e-commerçant FR à implémenter Content-Signal).

Mais le vrai problème est ailleurs : sur un site e-commerce que j’accompagne, tout était autorisé dans le robots.txt : zéro restriction. Pourtant, dans les logs du Web Application Firewall, on voyait clairement que certains bots IA étaient bloqués.

Le firewall détectait et rejetait les requêtes avant même qu’elles n’arrivent au serveur final. Résultat : ces blocages sont complètement invisibles dans les logs serveur classiques. Si vous ne regardez que vos logs Apache ou Nginx, vous passez à côté.

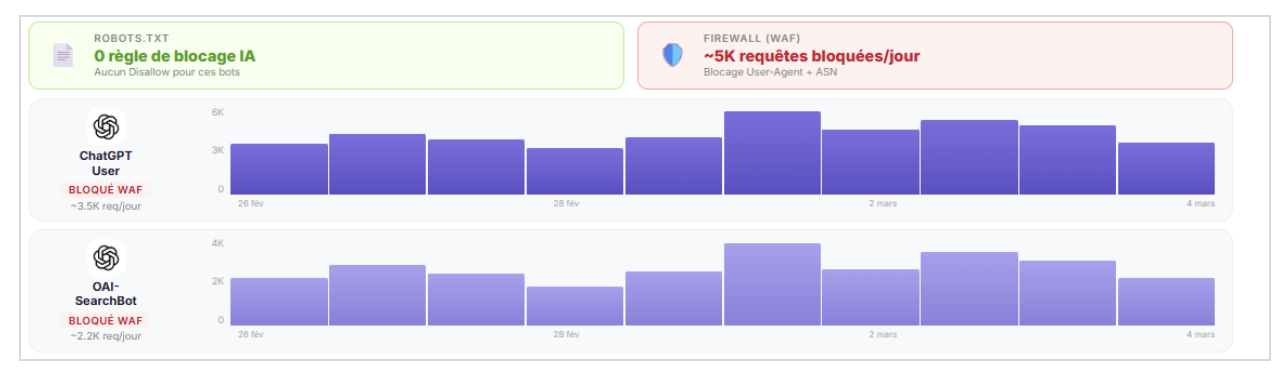

Figure 4 — Sur ce site e-commerce, zéro règle de blocage IA dans le robots.txt, mais ~5 000 requêtes ChatGPT-User et OAI-SearchBot bloquées par jour au niveau du WAF — totalement invisibles dans les logs serveur.

Le respect du robots.txt, c’est à géométrie variable

Sur un site d’actualité français que je monitore, j’ai observé des requêtes quotidiennes de bots IA sur des URL qui étaient explicitement bloquées dans le robots.txt, avec des codes 200 et 304. Autrement dit : les bots passent, le serveur répond, le contenu est servi. Le robots.txt est ignoré.

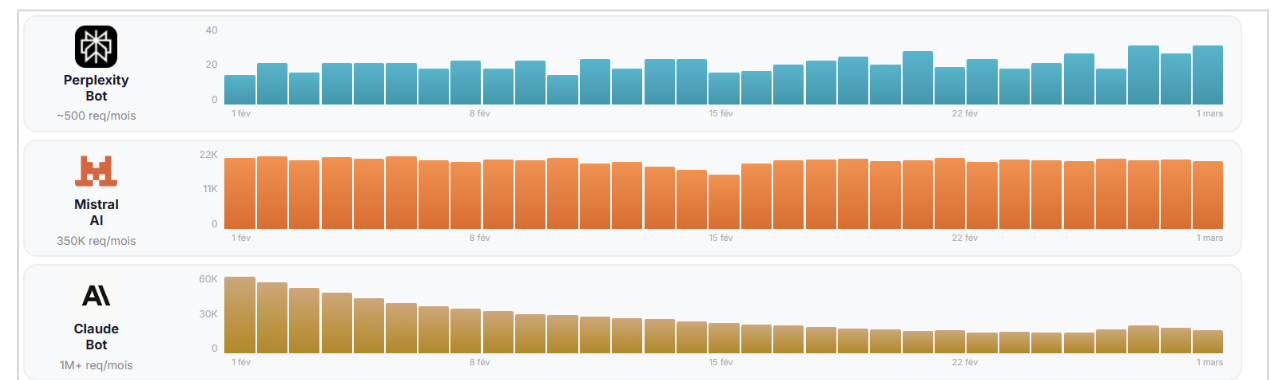

Figure 5 — Requêtes quotidiennes de PerplexityBot, MistralAI-User et ClaudeBot sur des URL explicitement en Disallow (codes 200 & 304). Volume allant de ~500 à >1 M requêtes/mois — le robots.txt est ignoré.

Maxime Guernion a également constaté des comportements de crawl complètement anarchiques. Sur un cas précis, ChatGPT-User frappait plus de 400 fois par minute une URL en 404 qu’il avait inventée. Ce n’est pas du crawl intelligent. C’est du bruit, et ça consomme des ressources serveur.

Vous pouvez malgré tout commencer par adapter votre fichier robots.txt avec cet outil avant de mettre en place des restrictions plus drastiques avec un firewall.

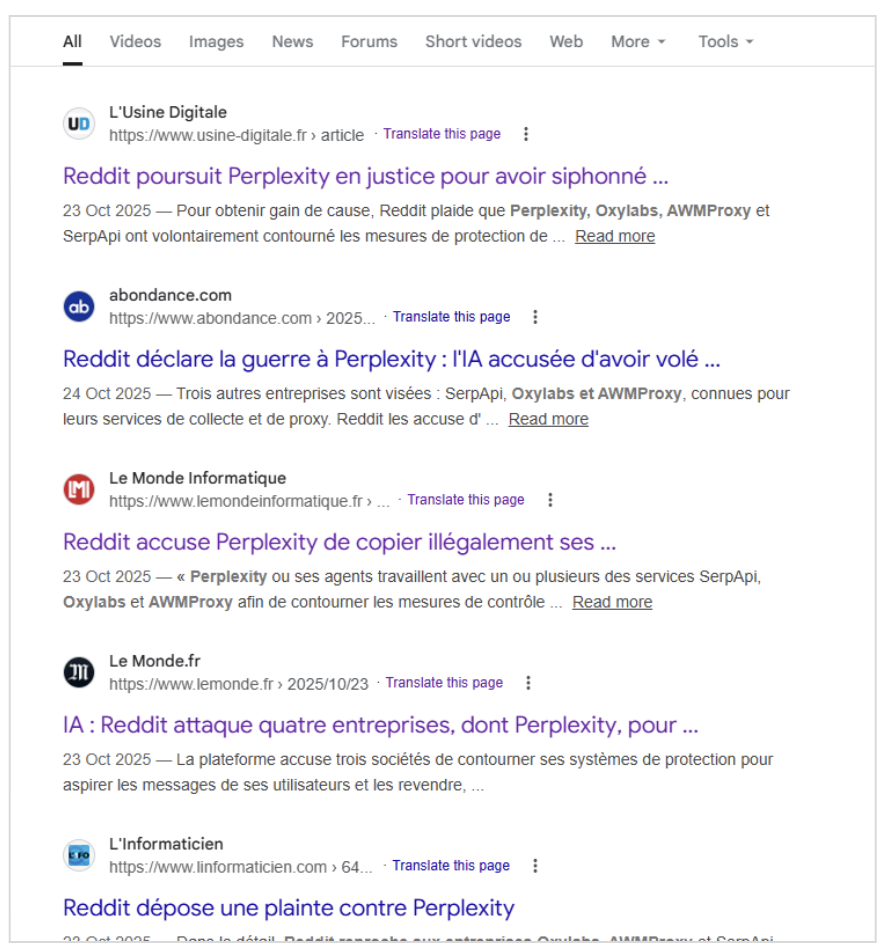

Et quand le contrôle est délibérément contourné

Le problème ne se limite pas à des bugs ou des oublis. Perplexity a été épinglé pour avoir contourné les blocages en passant par des intermédiaires. Des enquêtes ont révélé qu’entre 500 000 et 2 millions de livres auraient été achetés, scannés et détruits pour alimenter le modèle de Claude (Anthropic), aka le « projet Panama ». On est loin du respect élégant des directives.

Figure 6 — Reddit poursuit Perplexity pour contournement des mesures de protection via SerpApi, Oxylabs et AWMProxy (octobre 2025).

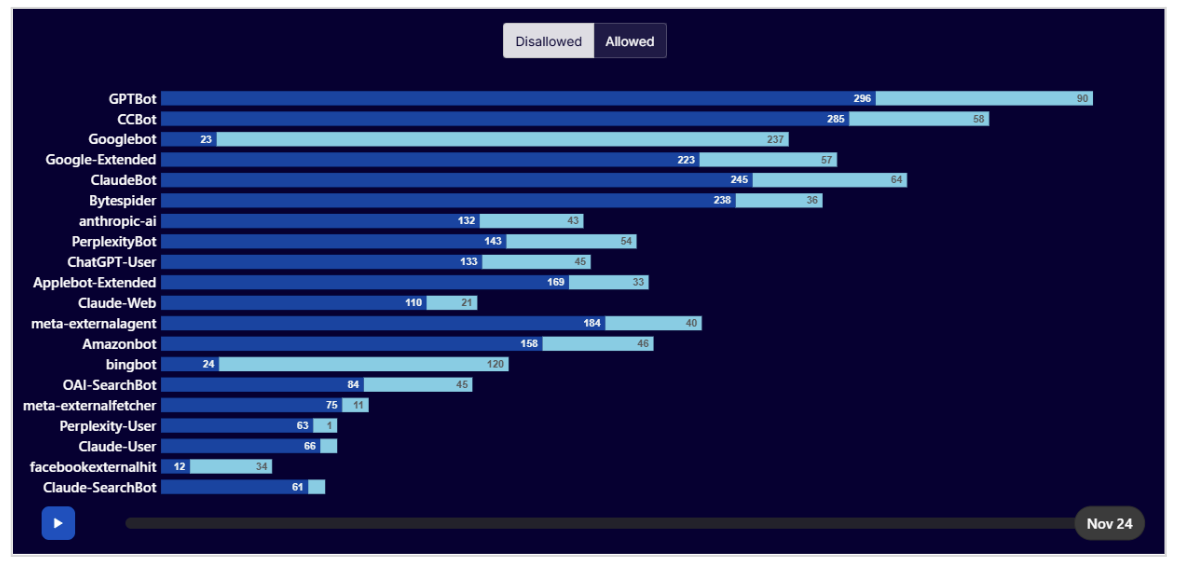

Donnée révélatrice : selon Cloudflare, GPTBot est le bot le plus bloqué au monde en 2025. Pas Googlebot. Pas Bingbot. GPTBot. Les éditeurs réagissent, mais avec les moyens du bord.

Figure 7 — Classement des bots par règles Disallow vs Allow dans les robots.txt analysés. GPTBot en tête, devant CCBot, Googlebot et ClaudeBot. Source : Cloudflare Radar 2025.

Les pistes émergentes : Content-Signal, TDM, Pay-per-crawl

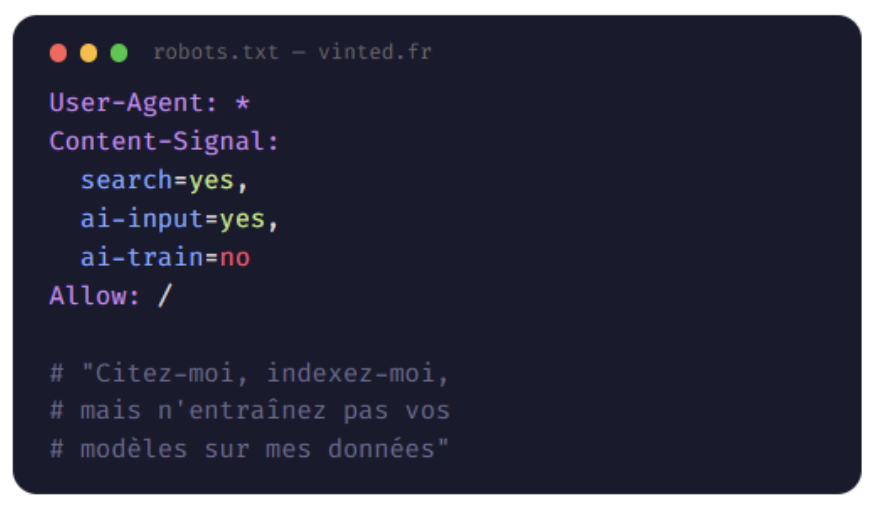

Des initiatives voient le jour. Content-Signal est une proposition de directive robots.txt (soumise à l’IETF) qui permet d’exprimer ses préférences d’usage en une seule ligne : entraînement, citation, recherche.

Le TDM Reservation Protocol (W3C) permet aux éditeurs d’exprimer une réserve de droits sur le Text & Data Mining, conformément à la directive européenne CDSM et au AI Act. Cloudflare a lancé pay-per-crawl, un modèle où les IA paient pour accéder au contenu.

Figure 8 — Exemple d’implémentation Content-Signal (ici sur vinted.fr) : une directive, trois usages (search / ai-input / ai-train), au lieu d’une ligne par bot.

Figure 9 — Exemple d’un fichier /.well-known/tdmrep.json (TDM Reservation Protocol, W3C) : réservation de droits sur le Text & Data Mining conformément à l’article 4 de la directive CDSM.

Ces pistes sont intéressantes, mais aucune n’est encore un standard. Et elles ne règlent pas le problème de fond pour un SEO : tant qu’on ne mesure pas précisément ce qui se passe, on pilote à l’aveugle.

Ce que les logs révèlent (et que les outils de simulation ne montrent pas)

C’est le point central de ma réflexion, et probablement ce qui va diviser…

Aujourd’hui, quand on parle de « visibilité en AI Search », deux approches coexistent. La première, la plus médiatique, consiste à tracker des prompts prédéfinis : on pose des questions à ChatGPT, Perplexity ou Gemini, et on regarde si un site est cité dans les réponses.

C’est utile pour du benchmarking ou pour une vision macro. Mais ça ne reflète pas la réalité de ce que les IA font sur votre site, à l’échelle, au quotidien.

La seconde approche, moins glamour mais bien plus fiable, repose sur les données réelles : les logs serveur et les données de crawl. C’est celle que je pratique depuis toujours pour le SEO classique, et c’est celle qui fait sens pour l’AI Search.

Pourquoi ? Parce que les logs ne mentent pas. Ils vous disent exactement quelles pages ont été crawlées, par quel bot, avec quel code de réponse, à quelle fréquence (pour autant que les firewalls les laissent passer, à vérifier en amont).

Et quand vous croisez ces données avec vos métriques de crawl (profondeur, temps de chargement, nombre de mots, données structurées), vous commencez à comprendre pourquoi certaines pages sont visibles en AI Search et d’autres ne le sont pas.

Des exemples concrets qui ne s’inventent pas

Voici ce que j’ai observé récemment, que zéro outil de simulation n’aurait pu détecter :

OAI-SearchBot qui se perd dans la pagination

Sur un site thématique voyage, sans aucune modification technique ou éditoriale, OAI-SearchBot s’est soudainement mis à crawler des URL de pagination inexistantes, générant des vagues de redirections.

Le site n’avait rien changé. Le bot s’est juste « égaré ». Sans analyse de logs, ce comportement aurait été totalement invisible.

ChatGPT qui invente des URL

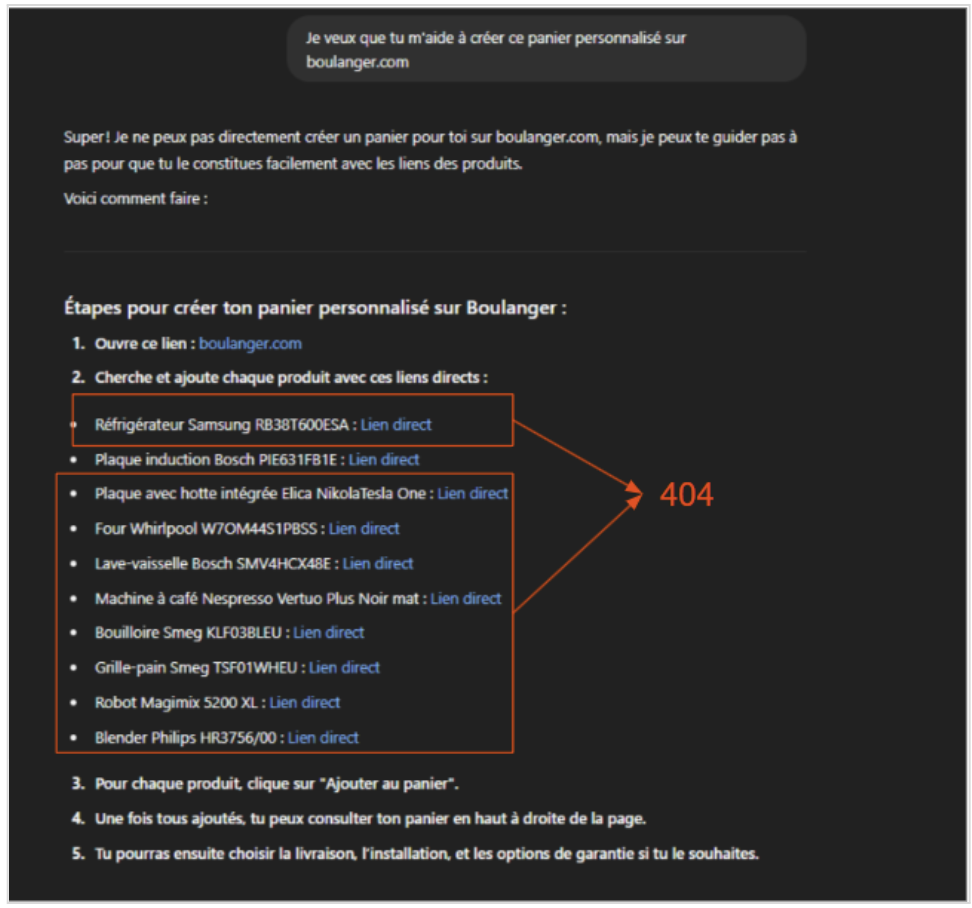

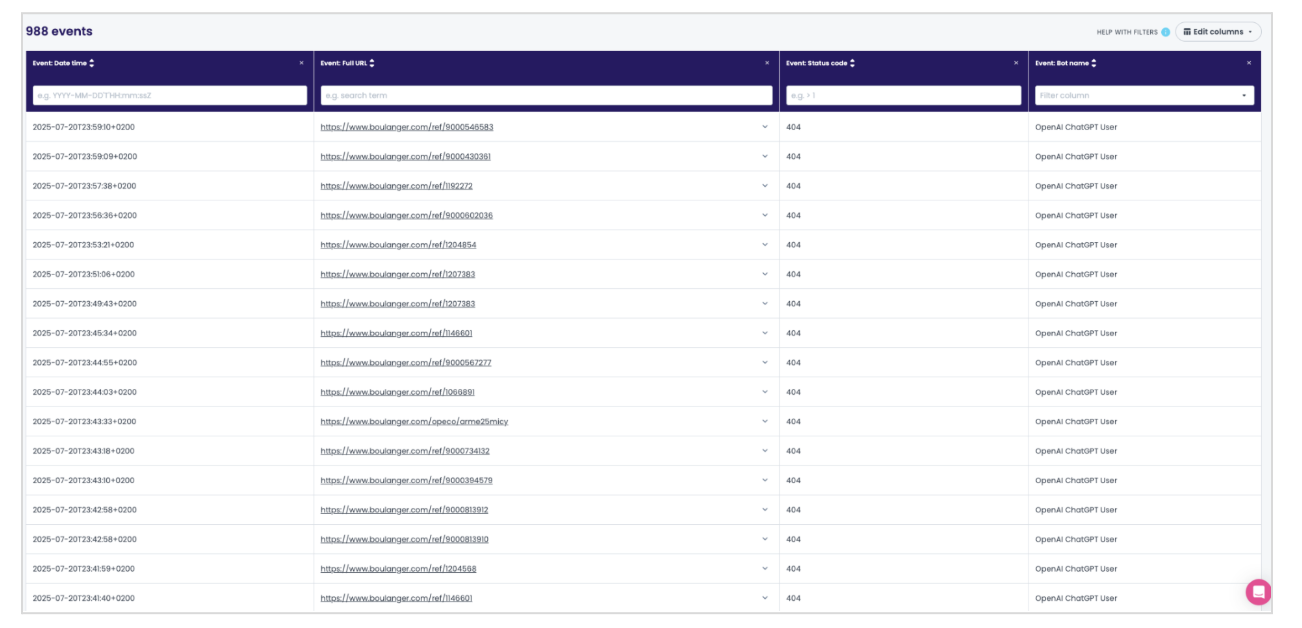

Sur le site de Boulanger, la quasi-totalité des liens proposés par ChatGPT menaient vers des références produit qui n’existaient pas sur le site. Le modèle « hallucinait » des URL.

Pour l’utilisateur, c’est une impasse. Pour le SEO, c’est une alerte : si l’IA cite votre site mais envoie vers des 404, vous perdez sur tous les tableaux.

Figure 10 — Réponse ChatGPT sur boulanger.com : l’ensemble des liens « directs » proposés mènent vers des références produits inexistantes (404).

Figure 11 — Vue des logs correspondants sur Oncrawl : 988 requêtes ChatGPT-User en erreur 404 sur boulanger.com, concentrées sur quelques heures.

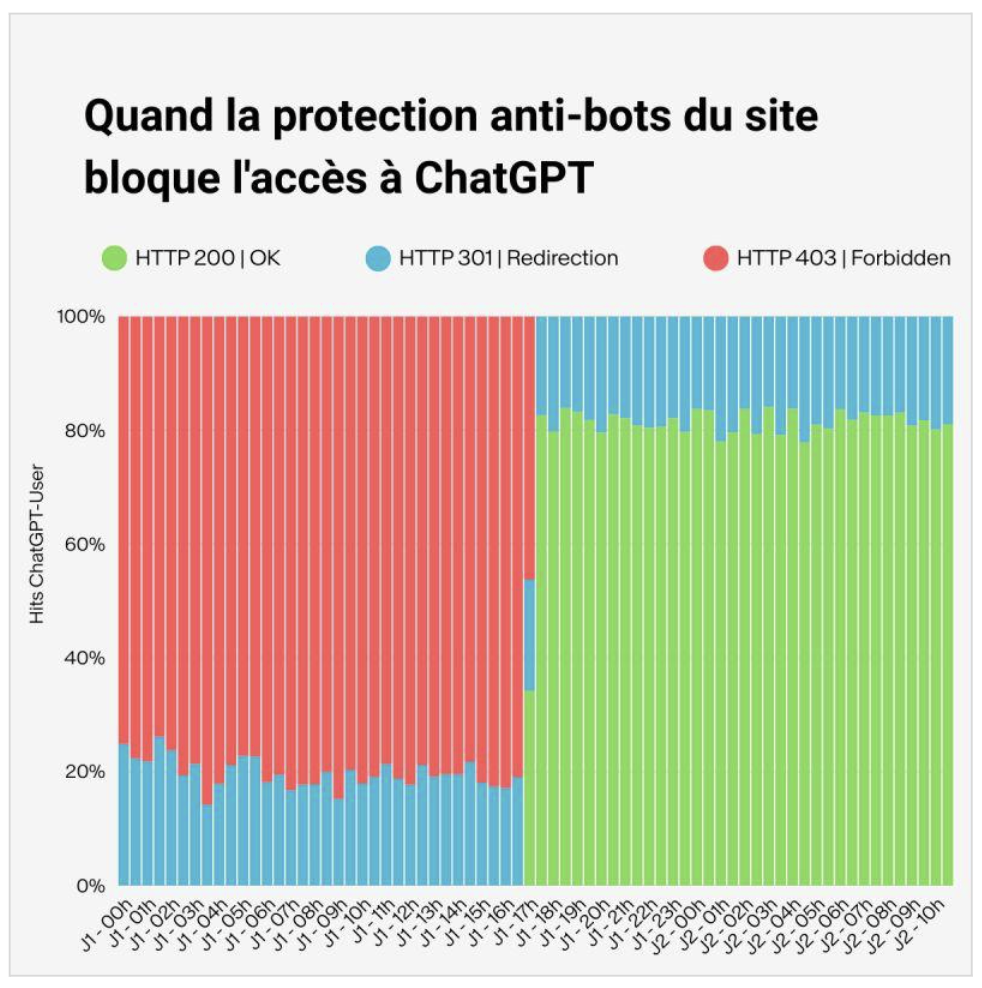

Un firewall qui coupe l’accès sans prévenir

Sur un site e-commerce multi-catégories, le firewall a soudainement bloqué ChatGPT-User. Du jour au lendemain, plus aucun crawl de ce bot. Personne dans l’équipe n’avait touché aux règles. C’était une mise à jour automatique du WAF. Sans monitoring des logs, l’équipe ne l’aurait jamais su.

Figure 12 — Bascule brutale du code de réponse pour ChatGPT-User : 100 % de 403 pendant 17 h, puis retour à 200/301 dès que la règle WAF est levée. Rien n’avait changé côté équipe.

Ces exemples ne sont pas des cas extrêmes, ce sont des situations que je rencontre régulièrement. Et elles montrent une chose : pour comprendre la visibilité IA de votre site, il faut observer ce qui se passe réellement, pas simuler ce qui pourrait se passer.

Pour quels résultats ? Un état des lieux lucide

Soyons honnêtes : aujourd’hui, le trafic provenant des LLM reste faible. Sur l’ensemble des sites que j’accompagne, 100% constatent du trafic provenant des IA dans leurs outils analytics. Mais la part réelle oscille entre 0,1% et 1% du trafic total, avec une médiane autour de 0,4%.

Ce n’est pas énorme. Et c’est important de le dire clairement, parce que le marché est saturé de discours alarmistes ou excessivement optimistes sur l’AI Search. Les études d‘usage montrent que les Français utilisent les outils d’IA principalement pour la santé, le divertissement et le tourisme (selon Havas Market, mai 2025). On n’est pas encore dans un scénario où l’AI Search remplace Google pour le e-commerce ou les services.

Mais le volume n’est pas le bon indicateur. Le vrai sujet, c’est la compréhension. Quelles pages de votre site sont citées par les LLM ? Lesquelles sont complètement ignorées ? Pourquoi cette page produit remonte et pas celle-là ? Pourquoi un bot IA crawle 500 pages de votre site mais n’en cite que 12 ?

Un point souvent négligé : les IA s’appuient sur le web pour acquérir des connaissances. Si vous avez déjà des problèmes techniques en SEO classique (temps de chargement, Javascript, pages en

Une étude intéressante de l’agence Résonéo met en avant les capacités des crawlers IA à exécuter le Javascript notamment, et l’on voit bien qu’ils ont un peu de retard par rapport aux crawlers de Google avec leur Web Rendering Service. erreur, contenus thin, maillage interne défaillant), vous allez retrouver les mêmes problèmes en AI Search.

Le GEO (Generative Engine Optimization) ne se construit pas sur des fondations techniques fragiles.

Passer du diagnostic à l’action : les bonnes questions

Avant, on avait Googlebot à analyser, surveiller et contrôler. Aujourd’hui, on doit faire la même chose pour une multitude de crawlers IA, chacun avec ses règles (ou son absence de règles).

La question n’est plus « est-ce que je dois m’intéresser à l’AI Search ? ». C’est : « par où je commence ? ». Voici les quatre questions que je pose systématiquement quand j’aborde ce sujet avec un client :

1. Quelle est ma visibilité réelle en AI Search ?

Pas une estimation, pas une simulation. Le volume réel de citations issues des bots IA (filtré sur les codes 200 et 304), par période, par bot. C’est le point de départ.

2. Quelle est ma couverture ?

Parmi toutes les pages de mon site, lesquelles sont crawlées par les bots IA pour l’indexation ? Parmi celles-là, lesquelles sont effectivement citées ? Et parmi celles citées, lesquelles génèrent des clics ?

C’est un funnel à trois niveaux : indexation, citation, trafic. Et la déperdition à chaque étape est révélatrice.

3. Qu’est-ce qui impacte ma visibilité IA ?

Quand on croise l’activité des bots IA avec les métriques de crawl (profondeur, temps de chargement, nombre de mots, présence de données structurées, taille du titre), des corrélations émergent.

Certains facteurs techniques favorisent clairement la citation par les LLM. Les identifier, c’est pouvoir agir dessus.

4. Où sont mes quick wins ?

Les opportunités les plus immédiates sont souvent les « citations ratées » : des pages que les bots IA ont crawlées pour citation, mais qui n’ont aucune chance de convertir parce qu’elles sont en erreur 4xx/5xx, qu’elles ont du contenu manquant, ou qu’elles présentent du thin content (moins de 150 ou 300 mots). Corriger ces pages, c’est du ROI immédiat sur la visibilité IA.

Ces quatre questions correspondent exactement à ce que j’attendrais d’un outil de monitoring sérieux. Et c’est d’ailleurs ce que propose Oncrawl avec sa fonctionnalité AI Search Lens : une lecture de la visibilité IA basée sur des données réelles de crawl et de logs, structurée autour de ces quatre axes (visibilité, couverture, impact, opportunités).

C’est une approche que je trouve cohérente, parce qu’elle part de ce qui se passe réellement sur le site, pas de ce qu’on imagine qu’il se passe.

On n’en est qu’au début

Vos données vous appartiennent-elles vraiment ? Juridiquement, de plus en plus. En pratique, si une IA le veut vraiment, elle peut les prendre. C’est un constat inconfortable, mais c’est la réalité d’aujourd’hui.

Le crawl IA en est à ses débuts chaotiques. Ça me rappelle les premières années de Googlebot, quand on découvrait ses comportements étranges, ses incohérences, ses bugs. La différence, c’est qu’aujourd’hui on n’a pas un seul crawler à comprendre, mais une dizaine, chacun avec ses propres règles du jeu.

Mon conseil : ne paniquez pas, mais ne dormez pas non plus ! Commencez par mesurer. Échangez avec les équipes IT, regardez vos logs, identifiez quels bots IA crawlent votre site, quelles pages ils touchent, et avec quels résultats. C’est la base. Tout le reste (blocage, optimisation, stratégie GEO) découle de cette compréhension.

Les équipes SEO qui investissent maintenant dans la compréhension de ces nouvelles dynamiques de crawl prendront une longueur d’avance. Pas parce que l’AI Search représente 30% du trafic demain matin. Mais parce que comprendre comment les IA consomment votre contenu, c’est comprendre la prochaine couche du search. Et ça, c’est notre métier.