Pourquoi utiliser une segmentation avancée ?

La segmentation avancée de vos données permet de mettre en lumière des problématiques spécifiques et permet également de se concentrer sur des échantillons précis de pages. Elle est souvent utilisée comme un angle de vue supplémentaire pour analyser vos données, à l’inverse de la vue classique basée sur les structures d’URL. Erlé avait rédigé un excellent article sur l’usage des segmentations avancées.

Objectif

Aujourd’hui, nous allons nous concentrer sur les segmentations les plus pertinentes, destinées à illustrer l’état de l’art et à mettre en avant les actions mises en place. Il s’agit donc de segmentations idéales pour le reporting auprès de votre direction. Malgré la multiplicité des résultats en fonction des secteurs d’activité et des volumétries d’URLs, un besoin SEO demeure universel : l’explication claire des actions entreprises et leur traduction, intelligible, auprès d’autres compétences.

Bénéficier de données exactes pour bâtir un reporting solide et transparent

L’usage d’une segmentation sur vos données de logs est certainement le meilleur moyen d’illustrer l’état de l’art de votre stratégie SEO actuelle. En termes de reporting, cela permet de démontrer facilement le comportement de Google sur votre site web.

Note : les captures utilisées dans cet article sont issues de sites web de différents secteurs d’activité mais tous comportent plusieurs millions d’URLs.

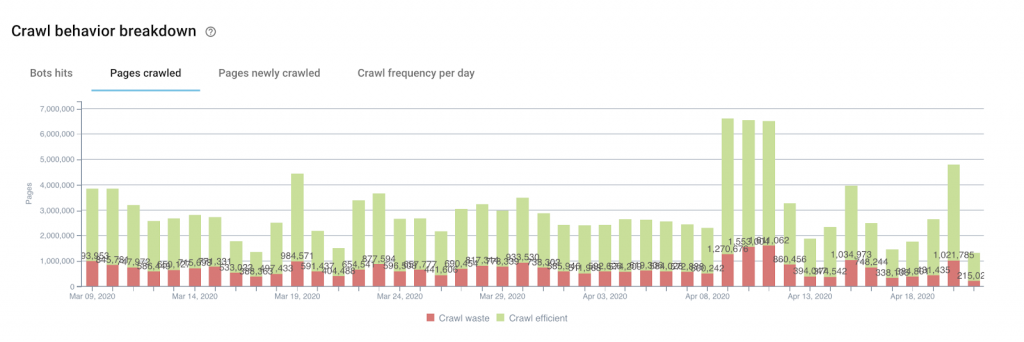

Le premier cas d’usage consiste à distinguer les URLs sur lesquelles vous devinez aisément que le crawl est nécessaire et bénéfique (crawl efficient sur la capture) ainsi que les URLs avec peu de valeur ajoutée, en dehors du scope de vos actions (crawl waste sur la capture).

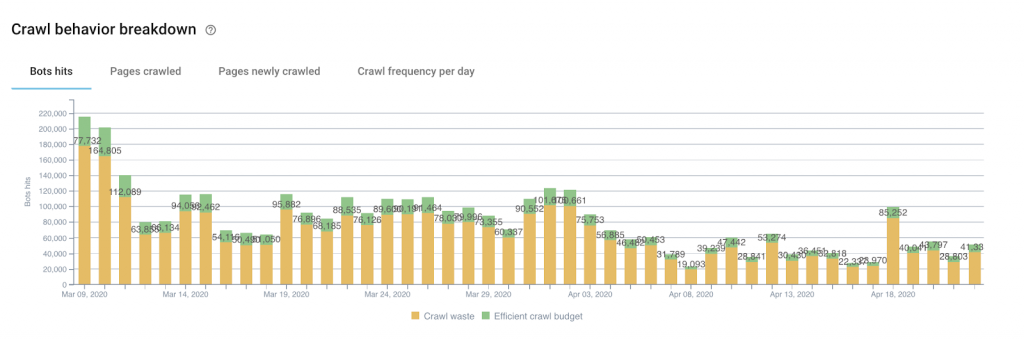

On peut également utiliser la même logique de segmentation sur le nombre de bots hits afin d’illustrer le propos en nombre de crawl journalier (une même page pouvant donc recevoir plusieurs visites de Googlebot) :

Comment bâtir ce type de segmentation ?

Tous les sites web ont leur spécificité mais le plus simple est de distinguer les pages en fonction de leur pattern. Certaines URLs, par leur structure, représentent vos money pages tandis que d’autres ont un intérêt plus faible voire contre productif pour vos performances. Cela constitue le premier moyen pour construire une telle segmentation, et la plus simple également.

Le crawl waste peut être représenté par les patterns suivants :

- Pagination

- Paramètres d’URLs

- Résultats de recherches internes

- URLs mal formées / mauvais encodage

- URLs non canoniques

- Facettes unique ou multiple

- URLs avec ID spécifiques

Bâtir une telle segmentation demande souvent de nombreux efforts lorsque les volumes d’URLs sont importants soit un temps non négligeable. Prenez ce facteur en compte et privilégiez la construction d’une telle segmentation le plus rapidement possible afin de pouvoir dresser un premier état des lieux sur des données réalistes et anticiper ainsi sur un comparatif à périmètre iso.

L’avantage d’un tel usage repose sur le fait que les données soient directement basées sur le comportement de Google, traduit dans les fichiers de logs. Les données ne mentent pas : elles sont le parfait reflet de la réalité. (…si, bien entendu, le dépôt des logs est exhaustif. Mais ça, c’est un autre sujet que nous aborderons plus tard.)

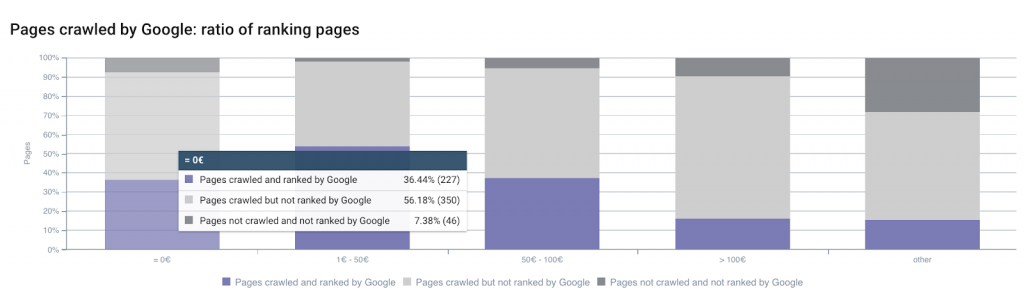

Nous utilisons également un autre type de segmentation qui permet de démontrer facilement, et ce par rapport à la valeur de la page ((Chiffre d’affaires e-commerce + Valeur totale de l’objectif) / Nombre de consultations uniques de la page considérée) :

- Le niveau de criticité d’une problématique SEO

- L’importance d’un lot d’optimisations à apporter sur un échantillon précis de pages

Quelles données utiliser ?

Il est nécessaire d’importer la donnée en provenance de Analytics en récupérant la valeur de la page pour chaque URL affichée après application du filtre : Trafic issu des résultats naturels. Pour ce faire, il faut se rendre sur :

- Comportement

- Toutes les pages

- Appliquer le filtre : résultats issus du trafic naturel

Cela permet d’avoir un export à l’URL par rapport à la période analysée.

Cette segmentation a l’avantage de s’appuyer sur les données business, idéal en matière de reporting. Si le SEO a l’étiquette méritée de science inexacte, vous pouvez toutefois vous appuyer sur ces données afin d’appuyer vos propos lorsqu’il s’agit de mettre en avant un axe d’optimisation.

Simplifier votre reporting avec la segmentation

Ces segmentations, parfois longues à mettre en oeuvre, ont l’avantage de simplifier votre reporting :

- La première se base sur une notion simple : est-ce que le passage de Google sur cette page est bénéfique par rapport à l’objectif d’acquisition de trafic ?

- La seconde permet de répondre à la question suivante : est-ce que je peux espérer augmenter la valeur de ma page en corrigeant telle problématique ?*

Ces segmentations sont également faciles à expliquer car basées sur des éléments tangibles et concrets.

Lors d’un premier audit par exemple, elles vous permettront de dresser un premier état des lieux en quelques minutes seulement !

* Il n’y a bien entendu pas de garantie à augmenter la valeur d’une page en corrigeant un élément technique en particulier mais l’analyse des Ranking factors (Ranking report) permet de mieux comprendre la pondération des différents signaux de positionnement vis-à-vis de l’historique des données.