Ne soyez pas Joey Donner.

Au milieu d’un couloir de lycée bondé, Joey Donner apparaît devant Bianca, (qui a sérieusement le béguin pour lui depuis la 15ème minutes environ du film Dix bonnes raisons de te larguer), brandit deux photos quasiment identiques et la force à choisir celle qu’elle préfère.

Joey : [tenant les portraits] “Laquelle tu préfères ?”

Bianca : “Hum, je pense que j’aime bien celle avec le haut blanc”.

Joey : “Ouais, c’est plus…”

Biance : « Pensif ?”

Joey : “Mince, j’allais dire réfléchi”.

Comme Bianca, les moteurs de recherche doivent faire des choix – t-shirt noir ou t-shirt blanc, classer ou ne pas classer (#ShakespearePuns !). Et aujourd’hui, avec l’explosion des contenus générés par l’IA, le choix est devenu encore plus complexe.

Selon Google, « 60% de l’internet est dupliqué » – ce qui représente une énorme quantité de ressources de stockage et de coûts indirects perdus (pour un faible retour #Lesbotsnontpasletempspourça) !

En apparence, la solution est simple : Ne soyez pas Joey Donner, en obligeant les robots des moteurs de recherche à choisir entre deux résultats identiques.

Cependant, si l’on plonge plus profondément dans l’état psychologique de Joey, on s’aperçoit qu’il ne sait pas qu’il est redondant.

Il ne se rend pas compte qu’il présente la même photo et une situation délicate à Bianca. Il n’est tout simplement pas conscient.

De même, le contenu dupliqué peut surgir d’une multitude de sources inattendues et les webmasters doivent être vigilants pour s’assurer qu’il ne gêne pas l’expérience de l’utilisateur et du robot.

Nous devons être attentifs et réfléchis quant au contenu que nous produisons et que nous voulons voir indexé.

Qu’est-ce que le contenu dupliqué ?

Comme le soulignent les directives de Google Search Central, le contenu dupliqué correspond à,

“D’importants blocs de contenu au sein ou à travers les domaines qui sont soit complètement similaires à un autre contenu ou bien comportent de sensibles similarités.”

Il est important de comprendre que des pages qui semblent virtuellement identiques à un utilisateur n’affecteront pas nécessairement son expérience sur le site.

En revanche, des pages dont le contenu est très similaire affecteront l’évaluation de ces pages par un robot de moteur de recherche.

Cette définition va au-delà des résultats identiques, elle inclut également les variations générées par l’intelligence artificielle et le contenu qui répond à la même intention sans apporter de valeur ajoutée.

Pourquoi les webmasters devraient se soucier du contenu dupliqué ?

Le contenu dupliqué pose quelques problèmes, principalement au niveau du positionnement, en raison des signaux confus qui sont envoyés au moteur de recherche. Ces problèmes sont les suivants :

- Des challenges d’indexation : les moteurs de recherche ne savent pas quelle version ils doivent inclure/exclure de leurs indices.

- Un faible impact de lien : comme différents résidents d’internet à travers le web pointent vers différentes versions de la même page, l’équité de lien se répand parmi ces multiples versions.

- Une compétition interne : lorsque le contenu est étroitement lié, les moteurs de recherche se débattent avec les différentes versions de la page qu’ils doivent classer dans les résultats de recherche (Elles sont trop similaires : comment un bot peut savoir ?!).

- Une faible bande passante de crawl : en forçant les moteurs de recherche à crawler les pages qui n’ont pas de valeur, vous perdez une partie du budget de crawl de votre site, ce qui peut être un grand préjudice pour les grands sites.

Qu’est-ce qui compte pour du contenu dupliqué ?

Le contenu dupliqué est souvent créé involontairement (la plupart du temps, nous ne cherchons pas à être Joey Donner).

Vous trouverez ci-dessous une liste de sources courantes à partir desquelles un contenu dupliqué peut être créé involontairement.

Il est important de noter que même si tous ces éléments doivent être vérifiés, il se peut qu’ils ne posent pas de problème (il est essentiel de hiérarchiser les principaux problèmes liés au contenu dupliqué).

Sources courantes de duplication :

- Les pages répétées (exemple : les pages de taille pour des produits avec les mêmes spécificités, les landing pages sponsorisées sur les moteurs de recherche avec des copies répétées)

- Les sites en dev indexés

- Les URLs avec différents protocoles (HTTP vs. les URLs en HTTPS)

- Les URLs sur différents sous-domaines (ex : www vs non-www)

- Les barres avec slash ou sans slash

- Les pages indexées (/index.html, /index.asp,etc…)

- Les URLs avec des paramètres (ex : suivi de clics, filtres de navigation, sessions IDs, code analytics, etc…)

- Les facettes

- Les versions imprimables

- Le contenu syndiqué

- Des communiqués de presse à travers les domaines

- Le contenu localisé (pages sans balises Hreflang appropriées, en particulier dans la même langue)

- Les variations de contenu générées par l’IA

- Les différences de rendu dynamique d’un appareil à l’autre

- Les duplications générées par le cadre JavaScript

Est-ce que le contenu dupliqué se positionne ?

Les positionnements étaient autrefois basés sur une sorte “d’enchère” qui faisait du contenu dupliqué dans les SERPs, hypothétiquement, une situation où le gagnant prenait tout.

Toutefois, le processus a évolué. Lorsqu’il s’agit de contenu dupliqué d’un domaine à l’autre, Google évalue désormais un certain nombre de critères qui ne se limitent pas à la question de savoir qui a publié le contenu en premier.

Bien qu’il y ait toujours une sorte “d’enchère,” elle est intégrée dans un processus dynamique qui prend en considération les éléments suivants :

- Unique insights and value-add beyond the original source

- L’actualité du contenu et la fréquence des mises à jour

- Si l’expertise et l’expérience de première main ont été démontrées

- Les signaux d’engagement et d’utilité des utilisateurs

- L’autorité du site et les signaux E-E-A-T

- Des perspectives uniques et une valeur ajoutée au-delà de la source d’origine

Les systèmes de Google évaluent en permanence la version qui répond le mieux à l’intention de l’utilisateur, ce qui signifie que le positionnement peut évoluer en fonction des différents critères susmentionnés.

Le premier éditeur peut avoir un avantage initial, mais le maintien de la pertinence du contenu, la démonstration de l’expertise et la fourniture d’une valeur unique sont désormais plus importants pour le succès du positionnement à long terme.

Cela ne veut toutefois pas dire que le contenu dupliqué – que ce soit sur le même domaine ou sur d’autres domaines – ne sera pas classé.

Il existe en effet des cas où Google détermine que le site d’origine est moins adapté pour répondre à un résultat et où un site concurrent est sélectionné pour le positionnement.

Est-ce que le contenu dupliqué devrait se positionner ?

Théoriquement, non. Si le contenu n’apporte aucune valeur aux utilisateurs dans les SERPs, il ne devrait pas être classé.

[Ebook] Le technical SEO pour les esprits non techniques

Faut-il s’inquiéter de la présence de contenu dupliqué sur son site ?

Concentrez-vous sur ce qui est le mieux pour l’utilisateur. Une préoccupation de base. Est-ce que cela répond à la question de votre utilisateur de façon significative pour l’expérience globale de votre site ?

Si un site doit avoir du contenu dupliqué (que ce soit pour des raisons politiques, légales ou de contrainte de temps) et qu’il ne peut pas être consolidé, signalez aux bots des moteurs de recherche comment ils doivent procéder avec l’une des méthodes suivantes – balises canoniques, balises meta robots noindex/nofollow ou avec un bloc à l’intérieur des robots.txt.

Il est aussi important de noter que le contenu dupliqué en lui-même ne mérite PAS de pénalité

Comment fait-on pour identifier du contenu dupliqué ?

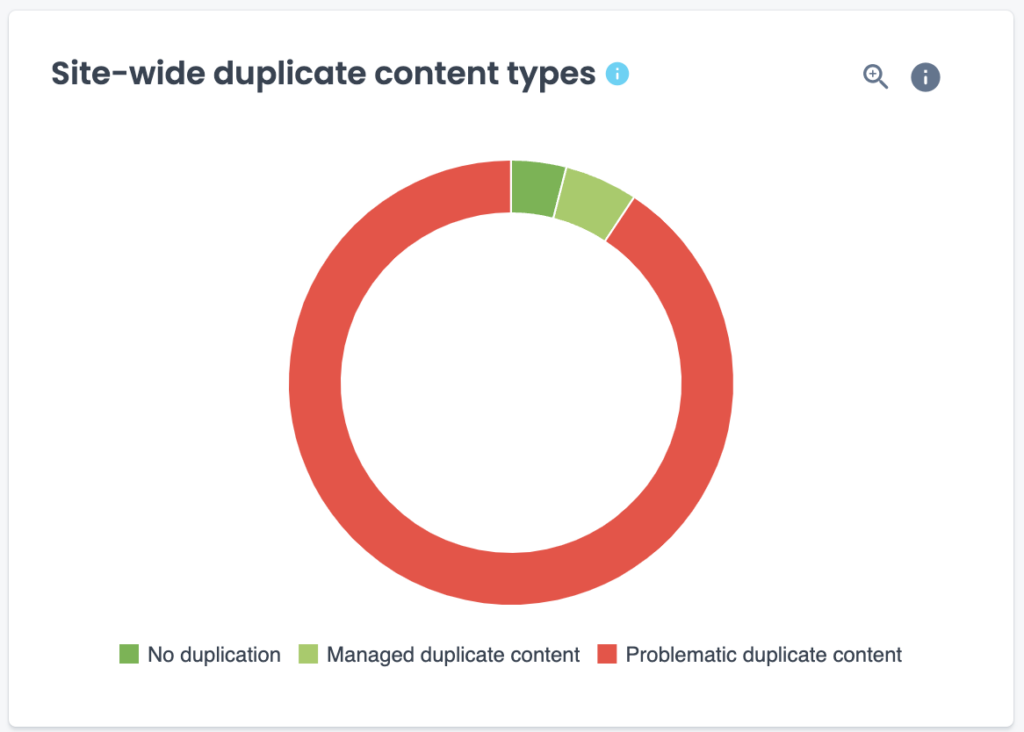

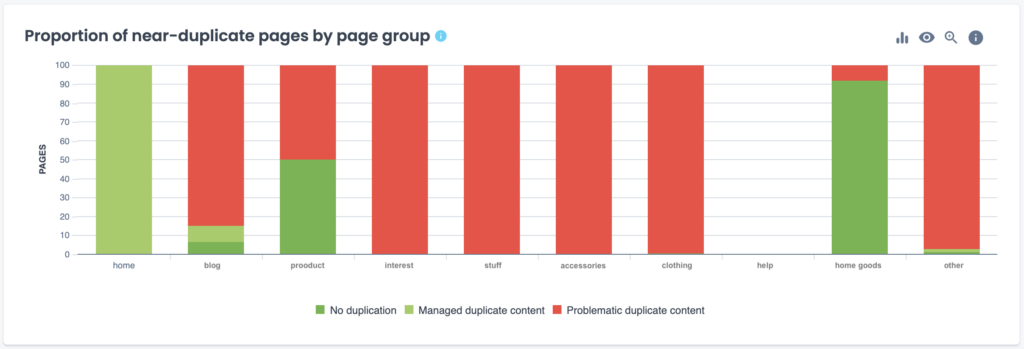

Oncrawl – Je manquerais à mon devoir si je ne mentionnais pas la visualisation du contenu dupliqué d’Oncrawl, parce qu’il s’agit de l’outil le plus performant du secteur.

L’un de mes aspects préférés est la façon dont Oncrawl évalue le contenu dupliqué par rapport aux canoniques. Si le contenu se trouve dans un cluster/groupe canonique spécifique, les problèmes peuvent généralement être considérés comme résolus.

Les rapports d’Oncrawl vont encore plus loin et peuvent afficher des données segmentées par sous-dossier. Cela permet d’identifier les zones spécifiques présentant des problèmes de contenu dupliqué.

Source : Oncrawl

Source : Oncrawl

Les solutions pour le contenu dupliqué

Les solutions pour le contenu dupliqué dépendent fortement de la cause. Cependant, voici quelques astuces. La résolution du contenu dupliqué requiert un bel équilibre entre le SEO technique et la stratégie de contenu.

Identifiez le parcours de vos utilisateurs

Comprendre où les utilisateurs se situent dans l’entonnoir marketing, avec quel contenu ils interagissent, et pourquoi ils interagissent avec lui peut vous aider à configurer l’architecture d’information générale de votre site ainsi que son contenu.

Ainsi, vous serez à même de créer des expériences utilisateurs intelligentes. Vous trouverez des échantillons de schémas de mapping de contenu ci-dessous (imprimez-les et remplissez-les !).

Créez une forte taxonomie hiérarchique d’URL et une architecture d’information

Si vous avez une tonne de sujets similaires, assurez-vous que vous avez une carte d’alignement de mots-clés claire. Surtout, vérifiez que vous n’avez pas cannibalisé votre propre trafic.

Priorisez les problèmes de contenu dupliqué

Lorsque vous identifiez du contenu dupliqué, il est vital de prioriser les problèmes de contenu dupliqué qui affectent votre performance (et intégrer cela dans votre stratégie globale de recherche organique).

Si les pages sont 100 % dupliquées et qu’une version n’a pas besoin d’être en direct, choisissez-la et consolidez-la avec une redirection en status HTTP 301.

Assurez-vous que tout le contenu sur vos pages soit indexable et indexé

Ce processus doit être basé sur le parcours de vos utilisateurs.

Pour prendre un exemple illustré, mon équipe a une fois identifié un problème où les commentaires depuis Facebook (qui étaient une mise en lumière pour les pages produits de ce site) n’étaient pas indexées.

Résoudre le problème des commentaires Facebook qui n’étaient pas crawlés ni indexés aurait transformé les pages de contenu faible en forum unique lié au produit.

Exploitez les balises HTML, robots.txt, et les status codes HTTP appropriés

Cela indique aux moteurs de recherche ce qu’ils doivent faire avec un type de contenu particulier.

- Les balises attributs pour indiquer les relations entre les documents :

- Balises canoniques : Je suis pareil que cette version !

- Rel=”prev/next : Je fais partie des séries paginées.

- Les URLs bloquées :

- Meta robots=”noindex” : Ne m’indexe pas. Note : Ne désindexez pas des pages avec de l’autorité de lien. Soyez stratégique avec l’autorité de lien.

- Meta robots=”nofollow” : Ne suis pas mes liens.

- Robots.txt disallow : Vous n’êtes pas autorisé à être ici.

- Status codes HTTP 403 : Les bots ne sont pas autorisés.

- Protection du mot de passe du serveur : Donnez-moi un mot de passe pour entrer.

Avancez stratégiquement : Consolidez, optimisez, créez, et supprimez

- Consolidez – Consolidez le contenu dupliqué s’il y a lieu avec des redirections 301 et des balises canoniques (lorsque les deux expériences doivent restées en direct).

- Optimisez – Pouvez-vous avoir une perspective unique ? Pouvez-vous mieux cibler ou aligner vos mots-clés ? Comment pouvez-vous recadrer ce contenu pour qu’il soit unique et utile ?

- Créez – Occasionnellement, il est pertinent de casser le contenu et de créer une expérience séparée et universelle.

- Supprimez – Élaguez le contenu peut aider la bande passante du crawl, car les moteurs de recherche ne seront pas forcés de crawler le même contenu qui n’ajoute pas de valeur à votre site répétitivement.

Si votre contenu a été volé, il existe deux possibilités primaires à tenter :

- Demander une balise canonique qui pointe vers votre site.

- Remplir une requête DCMA avec Google.

Templates de stratégie de cartographie de contenu

Le parcours utilisateur illustratif

Imprimez et étiquetez votre parcours utilisateur typique pour vous tester vous-même en exemple.

Étiquetez chaque type de contenu avec lequel l’utilisateur pourrait interagir au cours de son parcours et estimez le temps passé sur chaque étape.

Bien qu’il pourrait y avoir des étapes additionnelles et que le chemin peut ne pas être toujours linéaire.

Ajoutez des flèches et élargissez ; l’objectif est de s’exercer avec un exemple basique avant de plonger dans des cartographies complexes/engagées.

Carte de contenu d’entonnoir marketing simple

Imprimez et écrivez les objectifs, types de contenu, traits psychologiques communs, localisation de contenu, et ce qu’il faudrait pour pousser les utilisateurs à la prochaine étape de leur parcours.

L’idée est d’identifier quand les utilisateurs vont interagir avec certains contenus, ce qu’il se passe dans leurs esprits et comment les orienter dans leur voyage.

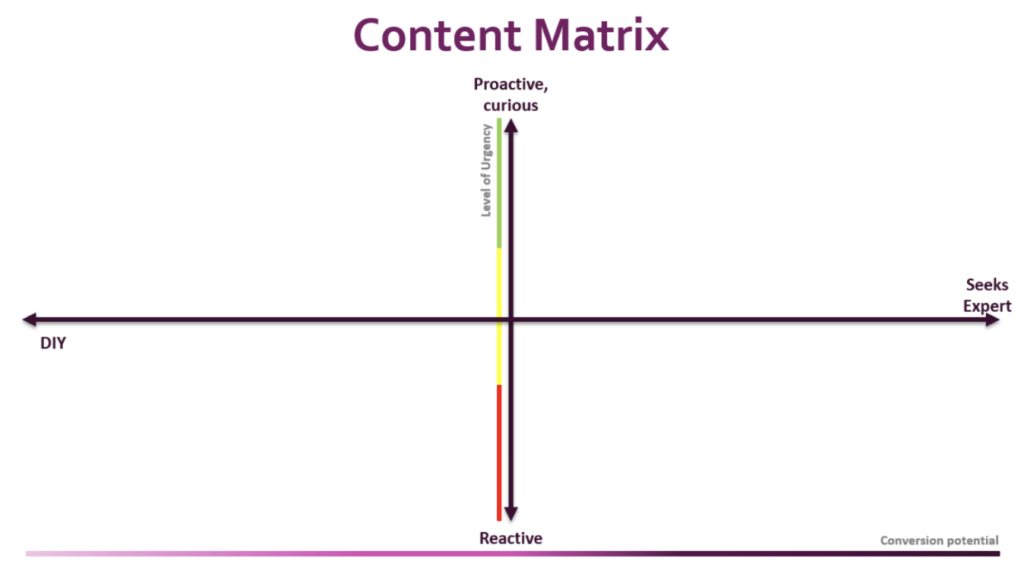

Matrice de priorisation de contenu

Imprimez et cartographiez les points avec les types de contenu disponibles, schématisés par points vitaux binaires.

Une fois que vous avez cartographié tout votre contenu, prenez du recul et observez s’il y a des domaines manquants.

Exploitez cette matrice pour prioriser le contenu le plus important, que ce soit par potentielle conversion ou par besoin.

Matrice de contenu retail

Commencez avec une cartographie d’intention informative à transactionnelle dans l’axe Y.

Les “Non-marque” et “marque” sont les critères les plus pertinents.

Matrice de contenu de gamme de service

Commencez avec les utilisateurs qui sont les plus proactifs versus les plus réactifs sur l’axe Y.

Puis, de transition à conversion potentielle.

Pour les services, cela pourrait ressembler à “Sollicitations d’experts” versus “DIY”.

Conclusion

Dans le contexte actuel qui voit les algorithmes de recherche progresser en permanence, lorsque nous parlons de gestion des problèmes de contenu dupliqué, il ne s’agit plus seulement de s’assurer que le contenu de nos pages n’est pas trop similaire à celui d’autres pages de notre site ou d’autres pages de l’internet.

Nous devons également nous assurer que chaque page apporte une véritable valeur ajoutée à l’expérience des utilisateurs. Comme le dilemme du photoshoot de Joey Donner, la clé est de faire en sorte que chaque élément de contenu soit vraiment unique, utile et pertinent.

Et n’oubliez pas que si certains contenus vieilliront inévitablement ou perdront de leur pertinence, il n’en va pas de même pour Dix bonnes raisons de te larguer – regardez-le à nouveau, certains classiques ne vieillissent jamais !

*Lecture recommandée

Si vous souhaitez en savoir plus sur le contenu dupliqué, vous pouvez consulter quelques-unes des ressources ci-dessous :