Le SEO technique est important car il est le point de départ de tout projet. Du point de vue d’un expert en référencement, chaque site web est un nouveau projet. Un site web doit avoir une base solide pour obtenir de bons résultats et atteindre les KPI les plus importants en matière de référencement.

Chaque fois que je commence un nouveau projet, la première chose que je fais est un audit du SEO technique. La plupart du temps, la résolution de problèmes techniques peut donner des résultats étonnants dès que le site web est remanié.

C’est drôle pour moi quand les gens parlent de contenu et surtout d’en avoir encore plus alors qu’ils ne disent pas un mot sur le SEO technique. Une chose est sûre, la santé des sites web et le référencement technique sont deux choses importantes qui seront cruciales en 2020. Je ne veux pas dire que le contenu n’est pas important. Il l’est, mais si l’on ne règle pas les problèmes techniques d’un site web, je ne pense pas que le contenu puisse apporter des résultats.

J’ai vu des cas où des pages importantes ont été bloquées par des directives dans le fichier robots.txt, ou les pages les plus importantes de catégories ou de services sont cassées ou bloquées par des méta-robots comme noindex, nofollow. Comment est-il possible de réussir sans établir de priorités en réglant d’abord ces problèmes ?

Il peut être surprenant de voir le nombre de SEO qui ne savent pas comment identifier les problèmes techniques à signaler aux webmasters. Je me suis souvenu qu’une fois, alors que je travaillais à l’entreprise, j’ai créé une feuille de contrôle d’audit SEO technique à l’usage de mon équipe. J’ai alors réalisé que le fait d’avoir à portée de main une fiche de correction rapide comme celle-ci peut énormément aider une équipe et générer un coup de pouce rapide pour un client. C’est pourquoi je considère qu’il est de la plus haute importance d’investir dans un outil/logiciel qui peut vous aider dans le diagnostic et les recommandations techniques en matière d’optimisation des moteurs de recherche.

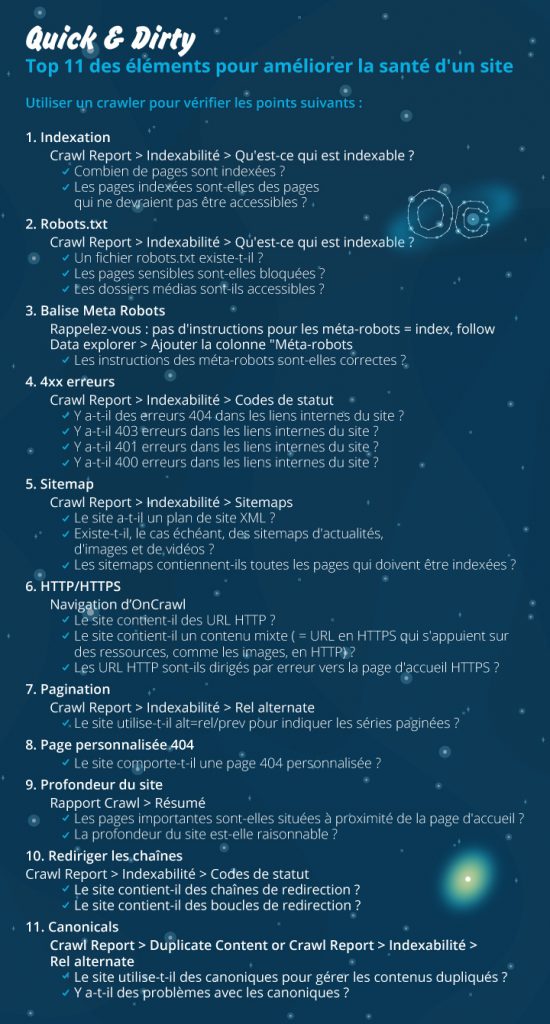

Commençons par le processus qui va vous permettre de mener un audit technique rapide qui fera une grande différence dans votre activité. Il s’agit d’un exercice qui vous prendra environ une heure à faire même si vous n’êtes pas un pro. Pour moi, l’utilisation d’un outil de référencement technique comme Oncrawl me rend la vie facile.

Je vais passer en revue les éléments les plus importants à vérifier lors d’un audit technique d’optimisation des moteurs de recherche. Il y a plus de choses que nous pouvons vérifier pour les problèmes de page, mais je veux me concentrer uniquement sur les choses qui créeront des conflits d’indexation et un gaspillage du budget de crawl. C’est en établissant des priorités que nous pourrons nous assurer que les pages les plus importantes seront indexées par Googlebot.

- Indexation

- Fichier Robots.txt

- Balise « Méta-robots

- 4xx erreurs

- Plans du site

- HTTP/HTTPS (sécurité du site web, problèmes de contenu mixte et de duplication de contenu)

- Pagination

- 404 pages

- Profondeur et structure du site

- De longues chaînes de redirection

- Mise en place de la balise canonique

1) Indexation

C’est la première chose à vérifier. L’indexation peut souvent être affectée par la configuration d’un plugin ou par une erreur mineure, mais l’impact sur la recherche peut être énorme, puisqu’aujourd’hui, plus de 6,16 milliards de pages web sont indexées. Vous devez comprendre que tout moteur de recherche fait un effort et que même Google doit donner la priorité à la page la plus pertinente pour l’expérience utilisateur. Si vous n’envisagez pas de rendre les choses plus faciles au Googlebot, vos concurrents le feront et gagneront beaucoup plus de confiance qu’avec un site web en bonne santé.

En cas de problèmes d’indexation, la mauvaise santé de votre site web se traduira par une perte de trafic organique. Le processus d’indexation signifie qu’un moteur de recherche crawl une page web et organise ensuite les informations dans le SERP. Les résultats dépendent de la pertinence pour l’intention de l’utilisateur. Si une page web ne peut pas ou a des problèmes de crawling, cela favorise d’autres pages dans la même niche à prendre l’avantage.

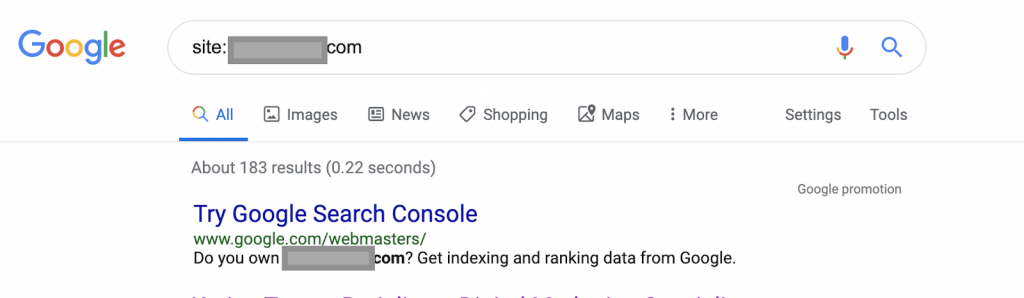

En utilisant des opérateurs de recherche par exemple :

Site : www.abc.com

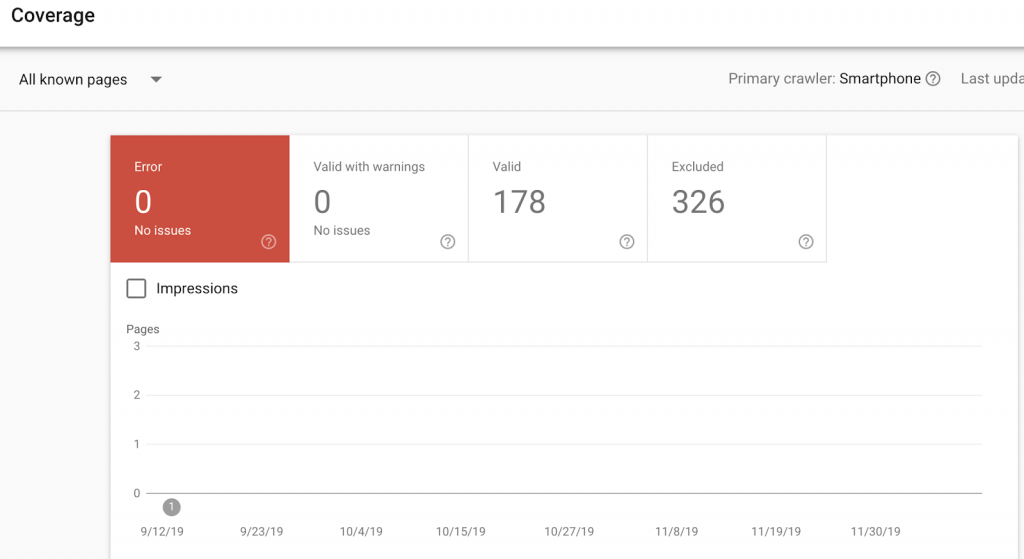

La requête retournera 183 pages indexées par Google. Il s’agit d’une estimation approximative du nombre de pages. Vous pouvez consulter la console de recherche Google pour connaître le nombre exact.

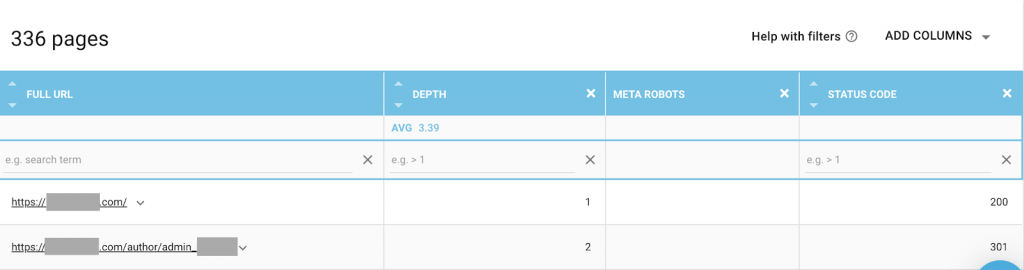

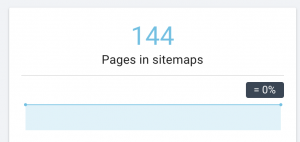

Vous devriez également utiliser un crawler comme Oncrawl pour lister toutes les pages auxquelles Google a accès. Ce dernier affiche un numéro différent, comme vous pouvez le voir ci-dessous :

Ce site web comporte près de deux fois plus de pages crawlables que de pages indexées.

Cela peut révéler un problème de duplication du contenu ou même un problème de version de sécurité du site entre HTTP et HTTPS. J’en parlerai plus loin dans cet article.

Dans ce cas, le site web a été migré du HTTP vers le HTTPS. Nous pouvons voir dans Oncrawl que les pages HTTP ont été redirigées. Les versions HTTP et HTTPS sont toujours accessibles à Googlebot et il se peut qu’il crawl toutes les pages en double, au lieu de donner la priorité aux pages les plus importantes à classer, ce qui entraîne un gaspillage du budget de crawl.

Un autre problème courant parmi les sites e-commerce sont les contenus mixtes. Pour faire court, ces problèmes surviennent lorsque votre page sécurisée contient des ressources telles que des fichiers multimédia (le plus souvent des images) uploadé à partir d’une version non sécurisée.

Comment réparer ça :

Vous pouvez demander à un développeur web de forcer toutes les pages HTTP à la version HTTPS, et de rediriger les adresses HTTP vers HTTPS en utilisant un code de statut 301.

Pour les problèmes de contenu mixte, vous pouvez vérifier manuellement la source de la page et rechercher les ressources uploadé avec « src=http://example.com/media/images », ce qui est presque insensé, surtout pour les grands sites web. C’est pourquoi il est indispensable d’utiliser outil SEO technique.

2) Fichier Robots.txt :

Le fichier robots.txt indique aux crawlers les pages qu’ils ne doivent pas explorer. Le guide des spécifications du fichier robots.txt indique que le format du fichier doit être du texte d’une taille maximale de 500 Ko.

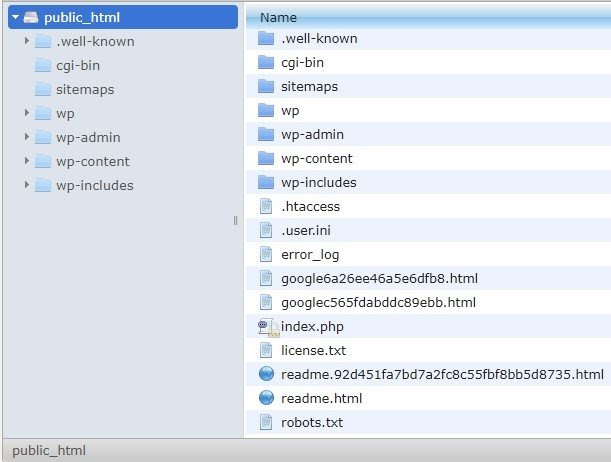

Je recommande d’ajouter le sitemaps au fichier robots.txt. Tout le monde ne le fait pas, mais je pense que c’est une bonne chose. Le fichier robots.txt doit être placé dans votre serveur hébergé en public_html et se place après le domaine racine.

Nous pouvons utiliser des directives dans le fichier robots.txt pour empêcher les moteurs de recherche de crawler des pages inutiles ou celles avec des informations sensibles, comme la page d’administration, les templates ou le panier d’achat (/cart, /checkout, /login, des dossiers comme /tag utilisé dans les blogs), en ajoutant ces pages dans le fichier robots.txt.

Conseils : Assurez-vous de ne pas bloquer le dossier des fichiers multimédia, car cela empêcherait l’indexation de vos images, vidéos ou autres médias auto-hébergés. Les médias peuvent être très importants pour la pertinence des pages ainsi que pour le classement organique.

3) Balise meta Robots

Il s’agit d’un morceau de code HTML qui indique aux moteurs de recherche s’ils doivent crawler et indexer une page, avec tous les liens qu’elle contient. La balise HTML est placée dans l’en-tête de votre page web. Il existe 4 balises HTML courantes pour les robots :

- No follow

- Follow

- Index

- No index

Lorsqu’il n’y a pas de balises méta-robots, les moteurs de recherche suivent et indexent le contenu par défaut.

Vous pouvez utiliser toute combinaison qui vous convient le mieux. Par exemple, en utilisant Oncrawl, j’ai constaté qu’une « page auteur » de ce site web ne contient pas de méta-robots. Cela signifie que la direction par défaut est (« follow, index »)

Cela devrait être (“noindex, nofollow”)

Pourquoi ?

Chaque cas est différent mais ce site web est un petit blog personnel. Un seul auteur publie sur le blog et le domaine est le nom de l’auteur. Dans ce cas, la page « auteur » ne fournit aucune information supplémentaire, même si elle est générée par la plateforme de blogs.

Un autre scénario peut être un site web où les catégories sur le blog sont importantes. Lorsque le propriétaire du site veut se classer pour les catégories de son blog, les méta-robots doivent être (« follow, index ») ou par défaut sur les pages de catégories.

Dans un autre scénario, pour un site web important et connu où les principaux experts en référencement écrivent des articles qui sont suivis par la communauté, le nom de l’auteur dans Google agit comme une marque. Dans ce cas, vous voudrez probablement indexer certains noms d’auteurs.

Comme vous pouvez le voir, les méta-robots peuvent être utilisés de nombreuses manières différentes.

Oncrawl SEO Crawler

Comment y remédier :

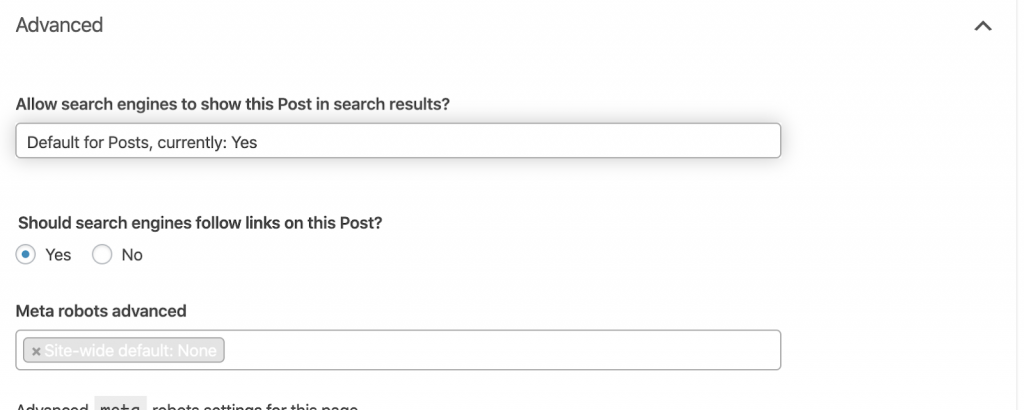

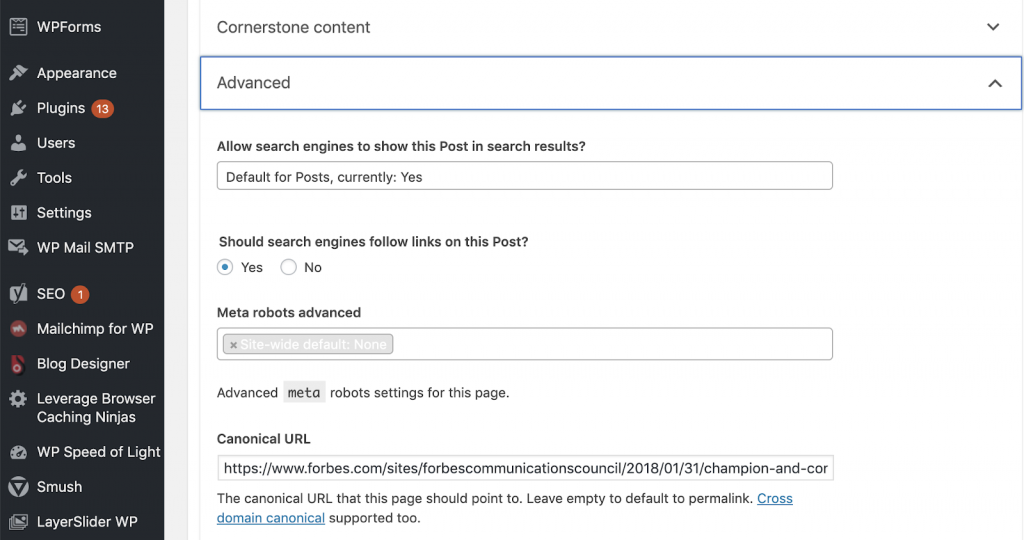

Demandez à un développeur de changer la balise du méta-robot selon vos besoins. Dans le cas ci-dessus, vous pouvez le faire vous-même en allant sur chaque page et en la modifiant manuellement. Si vous utilisez WordPress, vous pouvez le modifier à partir des paramètres de RankMath ou de Yoast.

4) Erreurs 4xx :

Il s’agit d’erreurs côté client et peuvent être 401, 403 et 404.

- Page 404 introuvable :

Cette erreur se produit lorsqu’une page n’est pas disponible à l’adresse URL indexée. Elle peut avoir été déplacée ou supprimée et l’ancienne adresse n’a pas été correctement redirigée à l’aide de la fonction 301 du serveur web. Les erreurs 404 sont une mauvaise expérience pour les utilisateurs et représentent un problème technique de référencement qui devrait être résolu. Il est bon de vérifier souvent les 404 et de les corriger afin d’économiser du également du budget de crawl.

Comment y remédier :

Nous devons trouver les adresses qui renvoient des 404 et les corriger en utilisant des redirections 301 si le contenu existe toujours. S’il s’agit d’images, elles peuvent être remplacées par des nouvelles en conservant le même nom de fichier.

- 401 Non autorisé

Il s’agit d’une question de permission. L’erreur 401 se produit généralement lorsqu’une authentification est requise, par exemple un nom d’utilisateur et un mot de passe.

Comment y remédier :

Voici deux options : La première consiste à bloquer la page des moteurs de recherche à l’aide de robots.txt. La seconde option consiste à supprimer l’exigence d’authentification.

- 403 Interdit

Cette erreur est similaire à l’erreur 401. L’erreur 403 se produit parce que la page comporte des liens qui ne sont pas accessibles au public.

Comment la corriger :

Modifiez la condition dans le serveur pour autoriser l’accès à la page (uniquement s’il s’agit d’une erreur). Si vous souhaitez que cette page soit inaccessible, supprimez tous les liens internes et externes de la page.

Comment y remédier :

Trouvez des liens vers ces URL et corrigez la syntaxe. Si ce n’est pas possible, vous devrez contacter le développeur web pour les corriger.

Remarque : on peut trouver 400 erreurs avec les outils ou dans la console Google.

5) Sitemaps

Le sitemaps est une liste de toutes les URL que le site contient et facilite la recherche, car il aide les crawlers à trouver et à comprendre votre contenu.

Nous disposons de différents types de sitemaps et nous devons nous assurer qu’ils sont tous en bon état.

Les sitemaps que nous devrions avoir sont les suivants :

- sitemap HTML : Il se trouvera sur votre site web et aidera les utilisateurs à naviguer et à trouver les pages de votre site

- sitemap XML : Il s’agit d’un fichier qui aidera les moteurs de recherche à crawler votre site web (il devrait être inclus dans votre fichier robots.txt).

- sitemap XML vidéo : Même chose que ci-dessus.

- sitemap XML pour les images : C’est aussi la même chose que ci-dessus. Il est recommandé de créer des sitemaps séparés pour les images, les vidéos et le contenu.

Pour les grands sites web, il est recommandé d’avoir plusieurs sitemaps pour une meilleure crawlibilité, car les sitemaps ne doivent pas contenir plus de 50 000 URLs.

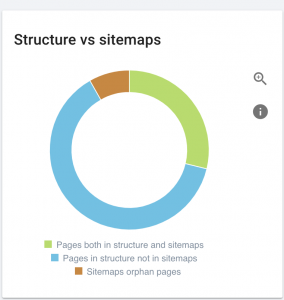

Ce site web a des problèmes de sitemaps

Comment y remédier :

Nous pouvons réparer cela en générant différents sitemaps pour : le contenu, les images et vidéos. Puis, nous les soumettrons via la Google Search Console et créerons un sitemap HTML pour le site web. Nous n’avons pas besoin d’un web developper pour cela. Nous pouvons utiliser n’importe quel outil en ligne pour générer des sitemaps.

6) HTTP/HTTPS (contenu dupliqué)

De nombreux sites web connaissent ces problèmes en raison de la migration du HTTP vers le HTTPS. Si tel est le cas, le site affichera les versions HTTP et HTTPS dans les moteurs de recherche. En raison de ce problème technique commun, les classements sont dilués. Ces problèmes génèrent également la duplication du contenu.

![]()

Comment y remédier :

Demandez à un développeur web de résoudre ce problème en forçant tous les HTTP à passer en HTTPS.

Remarque : ne redirigez jamais tout le HTTP vers la page d’accueil HTTPS, car cela générerait des erreurs 404.

7) Pagination

Il s’agit de l’utilisation d’une balise HTML (« rel = prev » et « rel = next ») qui établit des relations entre les pages et qui indique aux moteurs de recherche que le contenu présenté dans différentes pages doit être identifié ou relié à une seule. La pagination est utilisée pour limiter le contenu pour l’UX et le poids d’une page pour la partie technique, en les maintenant sous les 3MB. Il existe de nombreux outils gratuit pour vérifier la pagination.

La pagination doit avoir des références auto canoniques et indiquer un « rel = prev » et « rel = next ». Les seules informations en double seront le méta titre et la méta description, mais cela peut être modifié par les développeurs pour créer un petit algorithme afin que chaque page ait un méta titre et une méta description générés.

Comment y remédier :

Demandez à un développeur web d’implémenter des balises HTML de pagination avec une balise auto canonique.

8) Page 404 personnalisée

Une réponse 404 est, comme nous l’avons vu précédemment, une erreur « Not Found » qui amène les utilisateurs à un lien rompu ou à une page inexistante. C’est l’occasion de rediriger les utilisateurs vers le bon endroit. Il existe de très bons exemples de pages 404 personnalisées. C’est un must.

Voici un exemple d’une excellente page personnalisée 404 :

Comment y remédier :

Créez une page 404 personnalisée : pensez à quelque chose d’étonnant à y ajouter. Faites de cette erreur une opportunité pour votre entreprise.

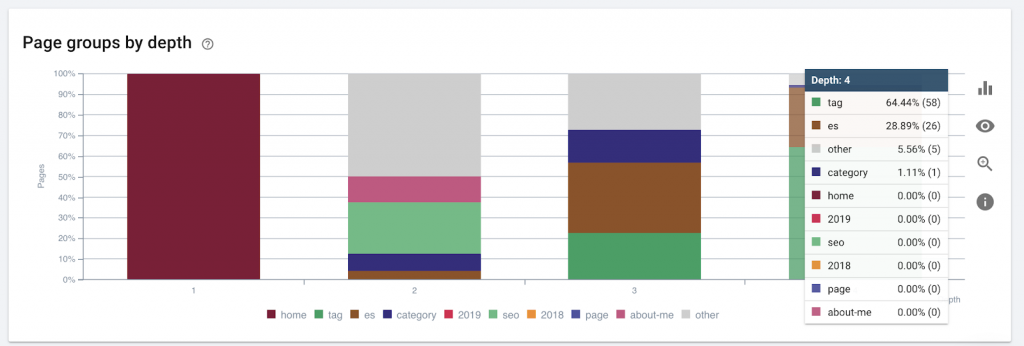

9) Profondeur/structure du site

La profondeur de page est le nombre de clics qui sépare la page la racine du site à cette même page. John Mueller de Google a déclaré que « les pages plus proches de la page d’accueil ont plus de poids ». Par exemple, imaginons que la page nécessite la navigation suivante pour être accessible :

La page « rugs » est à 4 clics de la page d’accueil. Il est recommandé de ne pas avoir de pages situées à plus de 4 clics de la home page, car les moteurs de recherche ont du mal à crawler plus profondément.

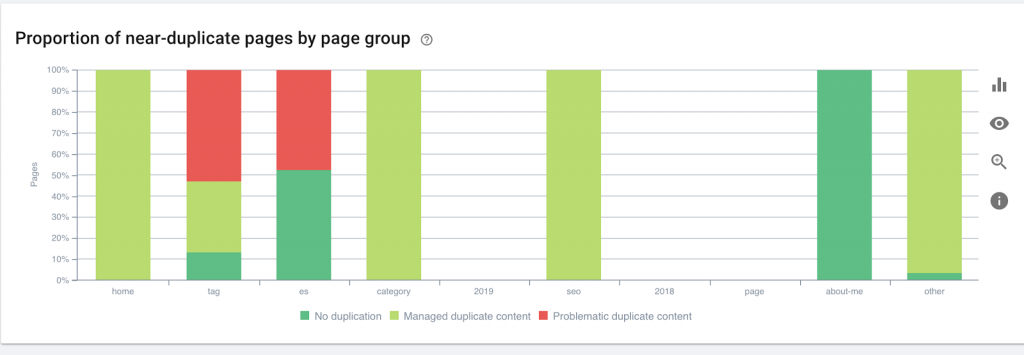

Ce graphique montre le groupe de pages par profondeur. Il nous aide à comprendre si la structure d’un site web doit être retravaillée.

Comment y remédier :

Les pages les plus importantes doivent être les plus proches de la page d’accueil pour améliorer l’UX et faciliter l’accès des utilisateurs. Il est très important d’en tenir compte lors de la création d’une structure ou restructuration d’un site web.

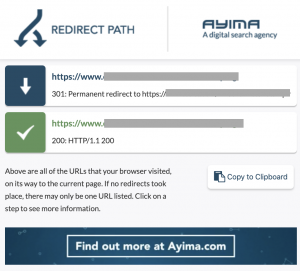

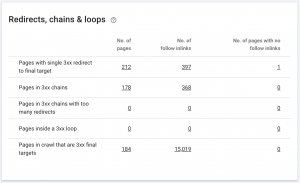

10. Chaînes de redirection

Une chaîne de redirection est une série de redirections entre des URL. Ces chaînes de redirection peuvent également créer des boucles. Cela pose également des problèmes au Googlebot et gaspille le budget de crawl.

Nous pouvons identifier les chaînes de redirections en utilisant l’extension Chrome Redirect path ou dans Oncrawl.

Comment y remédier :

La réparation est très facile si vous travaillez avec un site WordPress. Il suffit d’aller sur la redirection et de rechercher la chaîne. Supprimer ensuite tous les liens impliqués dans la chaîne si ces changements sont intervenus il y a plus de 2 ou 3 mois et laissez la dernière redirection vers l’URL actuelle. Les développeurs web peuvent également vous aider en effectuant toutes les modifications nécessaires dans le fichier .htacces, si nécessaire. Vous pouvez vérifier et modifier les longues chaînes de redirection dans vos plugins SEO.

11) Les canoniques

Une balise canonique indique aux moteurs de recherche que l’URL est une copie d’une autre page. C’est un problème important qui est présent sur de nombreux sites web. Si les balises canoniques ne sont pas mises en œuvre correctement ou si elles ne sont pas mises en œuvre du tout, cela créera des problèmes de duplication de contenu.

Les balises canoniques sont couramment utilisées sur les sites web e-commerce où un produit peut être trouvé plusieurs fois dans différentes catégories telles que : taille, couleur, etc.

Vous pouvez utiliser Oncrawl pour savoir si vos pages ont des balises canoniques et si elles sont correctement mises en œuvre ou non. Vous pouvez ensuite explorer et corriger les problèmes éventuels.

Nous pouvons utiliser Oncrawl pour savoir si certaines pages ont des balises canoniques et si elles sont correctement implémentées. Vous pouvez ensuite analyser et réparer les problèmes.

Comment y remédier :

Nous pouvons résoudre les problèmes canoniques en utilisant Yoast SEO si nous travaillons dans WordPress. Nous allons dans le tableau de bord de WordPress puis dans Yoast -setting – advanced.

Effectuer votre propre audit

Les SEOs qui veulent commencer à plonger sur SEO technique ont besoin d’un guide des étapes rapides à suivre pour améliorer la santé SEO. En parlant de l’optimisation technique des moteurs de recherche avec John Shehata, le vice-président de Conde Nast, lors de la journée mondiale du marketing à New York en octobre 2019.

Voici ce qu’il m’a dit :

« Beaucoup de gens dans l’industrie du SEO ne sont pas techniques. Maintenant, tous les référenceurs ne comprennent pas comment coder et il est difficile de demander aux gens de le faire. Certaines entreprises, ce qu’elles font, c’est qu’elles embauchent des développeurs et les forment pour devenir des référenceurs afin de combler le manque de compétences techniques en matière de SEO ».

À mon avis, les SEOs qui n’ont pas la connaissance complète du code peuvent quand même faire un excellent travail de référencement technique en sachant comment effectuer un audit, identifier les éléments clés, faire des rapports, demander aux développeurs web de mettre en œuvre les modifications et enfin tester les changements.

Prêt à commencer ? Télécharger la checklist maintenant !